针对部分服务器厂商缺乏一键应用模板,且许多开发者不希望引入庞大的容器增加系统开销等痛点,原生命令行直装成为了运行 OpenClaw(小龙虾)最硬核、最纯粹的选择。

原生命令直装的核心体验

放弃虚拟化环境,纯命令行部署能够为你带来最直接的底层掌控感:

- 极致轻量: 拒绝冗余进程常驻,最大化压榨和释放服务器物理性能。

- 告别繁琐编译: 绕开封装好的镜像黑盒。从配置 npm 镜像源加速下载依赖,到拉取源码直接运行,整个过程彻底抛弃复杂的编译打包步骤。代码或配置需要修改时,改完立刻生效,享受如同写纯 PHP 代码般所见即所得的敏捷工作流。

- 无视环境限制: 无论服务商是否提供面板支持,只要拥有一个基础的 Linux 终端,即可直接强行拉起并守护服务。

本文核心部署目标

本文将直奔主题,深入梳理 OpenClaw 小龙虾命令版本的纯净部署流程。涵盖从基础依赖与 npm 镜像源配置、源码拉取运行,到最终无缝对接 QQ 机器人的完整业务闭环,带你以最纯粹的代码方式构建专属 AI 交互枢纽。

第一章:Debian 13 底层环境准备与 Node.js 原生安装

本次部署实战以纯净的 Debian 13 系统为基础环境。运行 OpenClaw 小龙虾前,我们需要先在服务器上准备好 Node.js 运行环境以及源码版本控制工具。

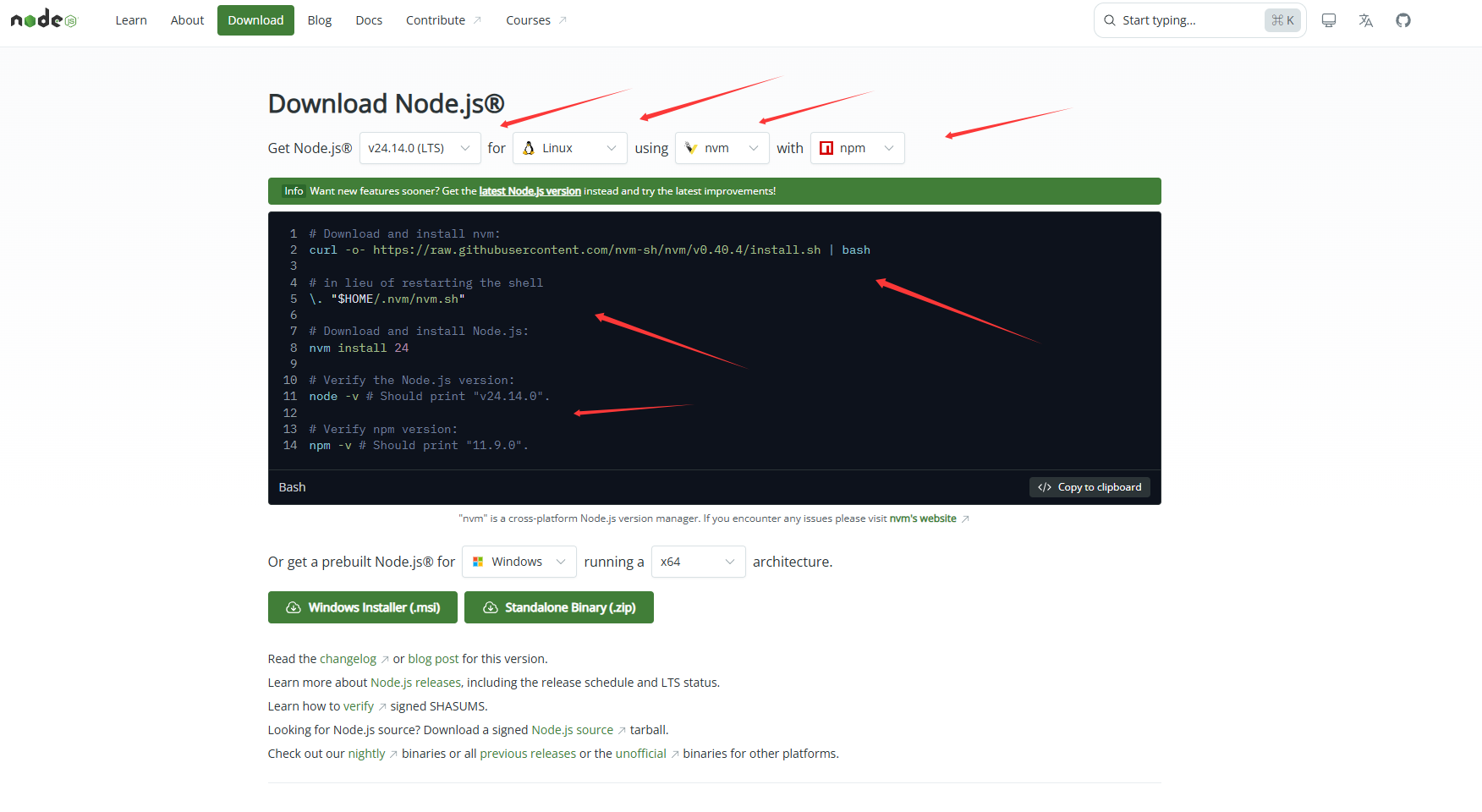

1. 获取 Node.js (nvm) 安装脚本

首先,打开 Node.js 官方网站(nodejs.org)的下载页面。 在页面提供的配置选项中,依次通过下拉框精准选择:操作系统选 Linux -> 工具选 nvm -> 包管理器选 npm。 此时,网页下方会自动生成一段针对你当前选择的安装命令集合。

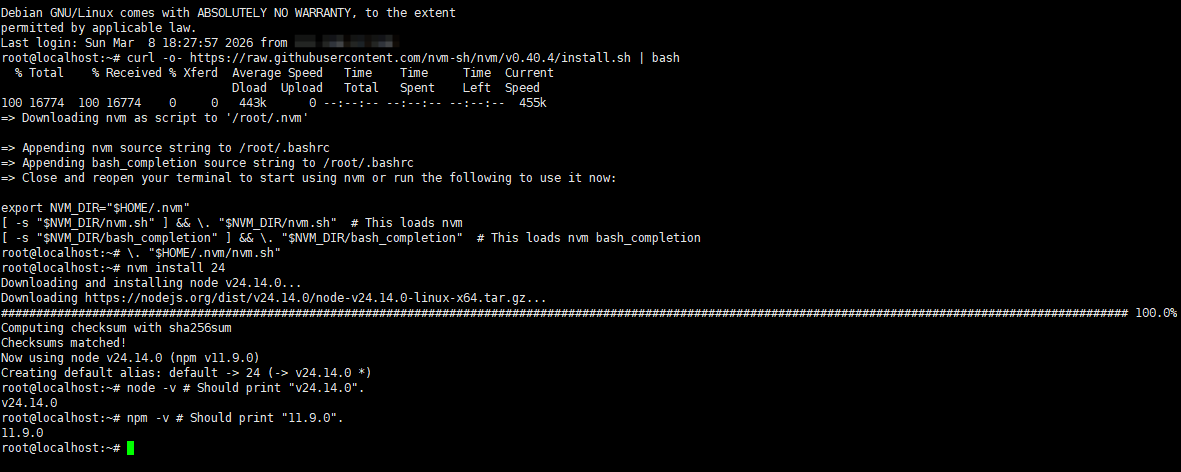

2. 终端执行环境部署命令

复制网页上生成的这 5 行完整代码,打开你的服务器 SSH 终端,直接粘贴并按回车执行。 这套脚本会自动拉取并安装 nvm (Node Version Manager),随后静默下载配置好对应版本的 Node.js 和 npm 核心运行环境。

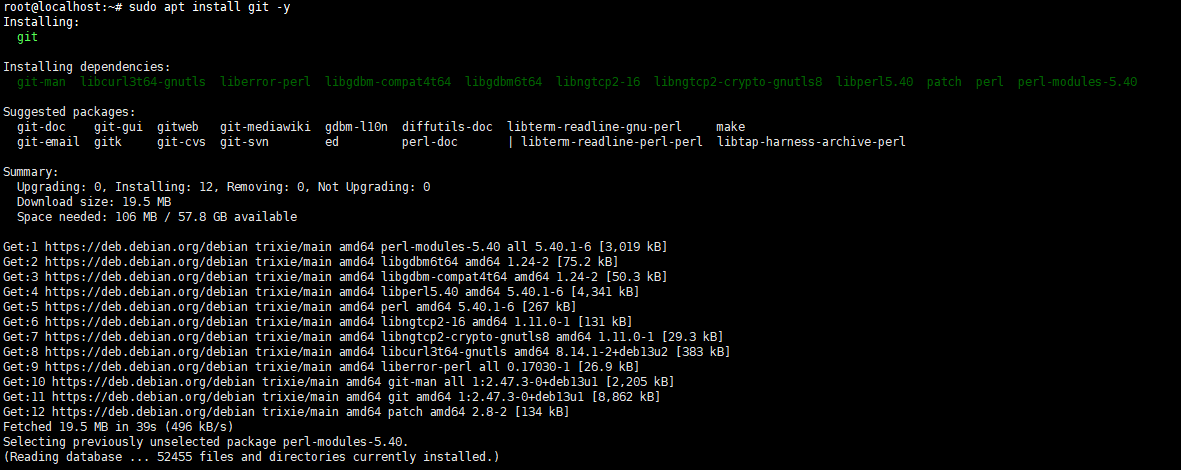

3. 补全系统 Git 依赖

由于我们需要直接拉取 OpenClaw 的源码进行运行,服务器必须具备 Git 工具。在终端中执行以下命令安装 Git 软件包:

sudo apt install git -y

⚠️ 防坑避雷: 强烈建议直接运行一次该命令。部分服务商提供的 Debian 系统镜像经过了重度精简,可能默认并不自带 Git。如果不提前确认并安装,后续执行克隆源码的操作时会直接抛出找不到命令的报错,阻断整个部署流程。

4. 配置 npm 淘宝镜像源(国内服务器建议配置)

如果你的服务器节点位于国内,直接拉取 npm 官方源的包大概率会遇到网络超时或连接中断的问题。我们需要手动将其切换为国内的淘宝镜像源以加速后续的依赖拉取;如果是海外服务器,则可以直接跳过此步骤。 在终端执行以下命令:

npm config set registry https://registry.npmmirror.com/第二章:获取 OpenClaw 核心程序与原生全局安装

底层环境就绪后,我们需要通过包管理器拉取 OpenClaw 的核心程序源码并完成系统的全局安装。

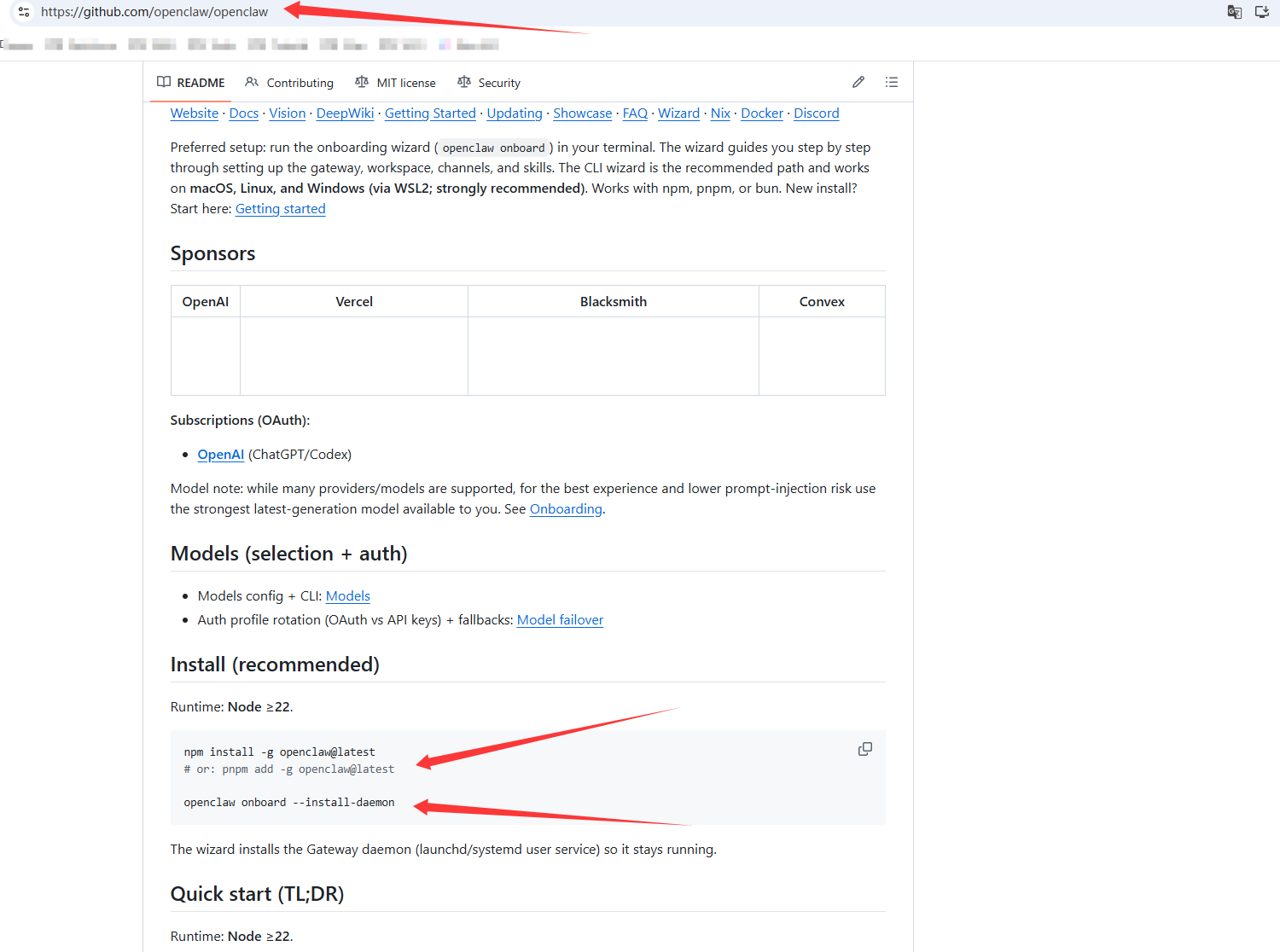

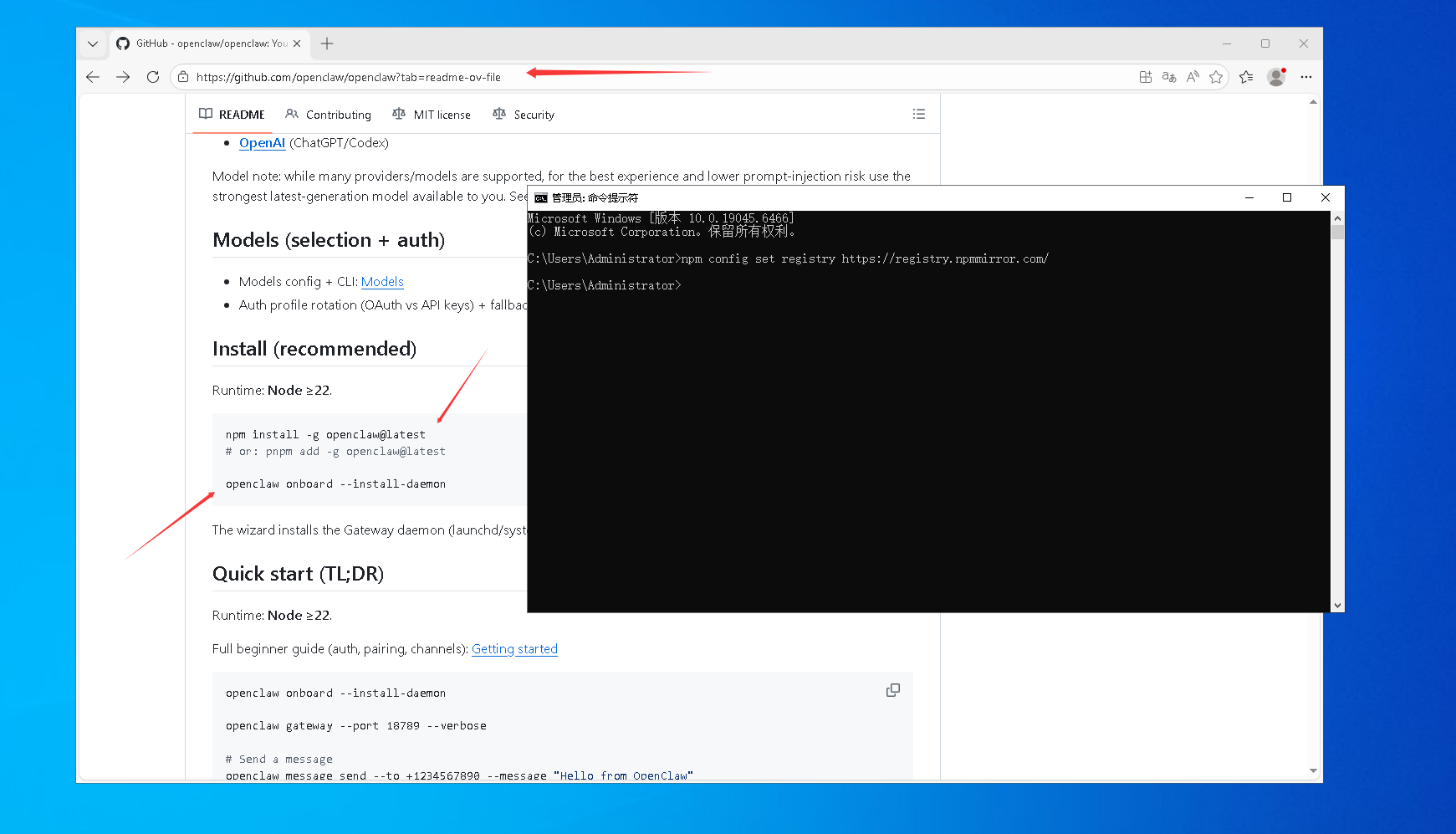

1. 获取官方原生安装命令

打开浏览器,访问 OpenClaw 的 GitHub 官方开源仓库(https://github.com/openclaw/openclaw)。 将页面向下拉,找到 Install (recommended) 区域。这里官方明确提供了两行核心代码:第一行用于拉取并全局安装核心包,第二行用于执行后续的配置引导。

⚠️ 网络环境避坑: 由于国内服务器或本地网络直连 GitHub 极易遇到访问超时的情况(除非具备魔法上网环境)。为了追求最高效的部署体验,建议直接跳过网页访问,复制下方我提取好的纯净命令进行操作。

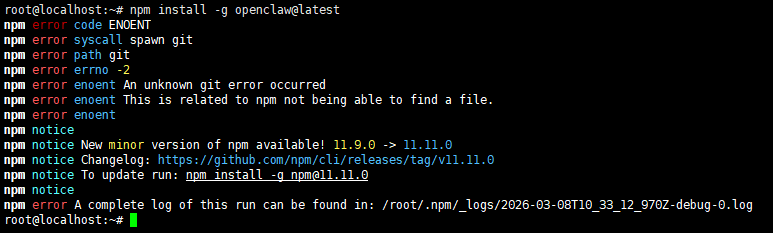

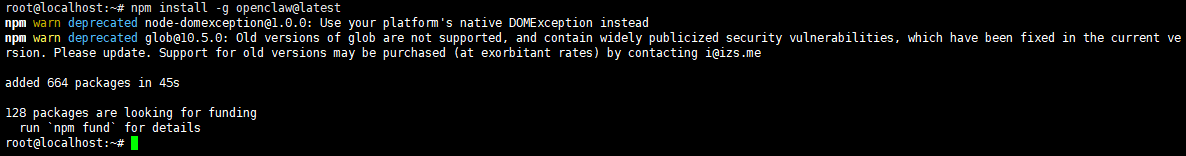

2. 拉取并执行全局安装

返回你的服务器终端,直接输入或粘贴以下安装命令,然后按回车执行:

npm install -g openclaw@latest得益于我们在第一章提前配置好的淘宝镜像源,系统此时会以极快的速度从国内节点拉取 OpenClaw 最新版的核心源码包及所有底层依赖。只需静待终端跑码,直到提示下载与解包完成即可。

第三章:初始化配置引导与腾讯混元 API 逐步接入解析

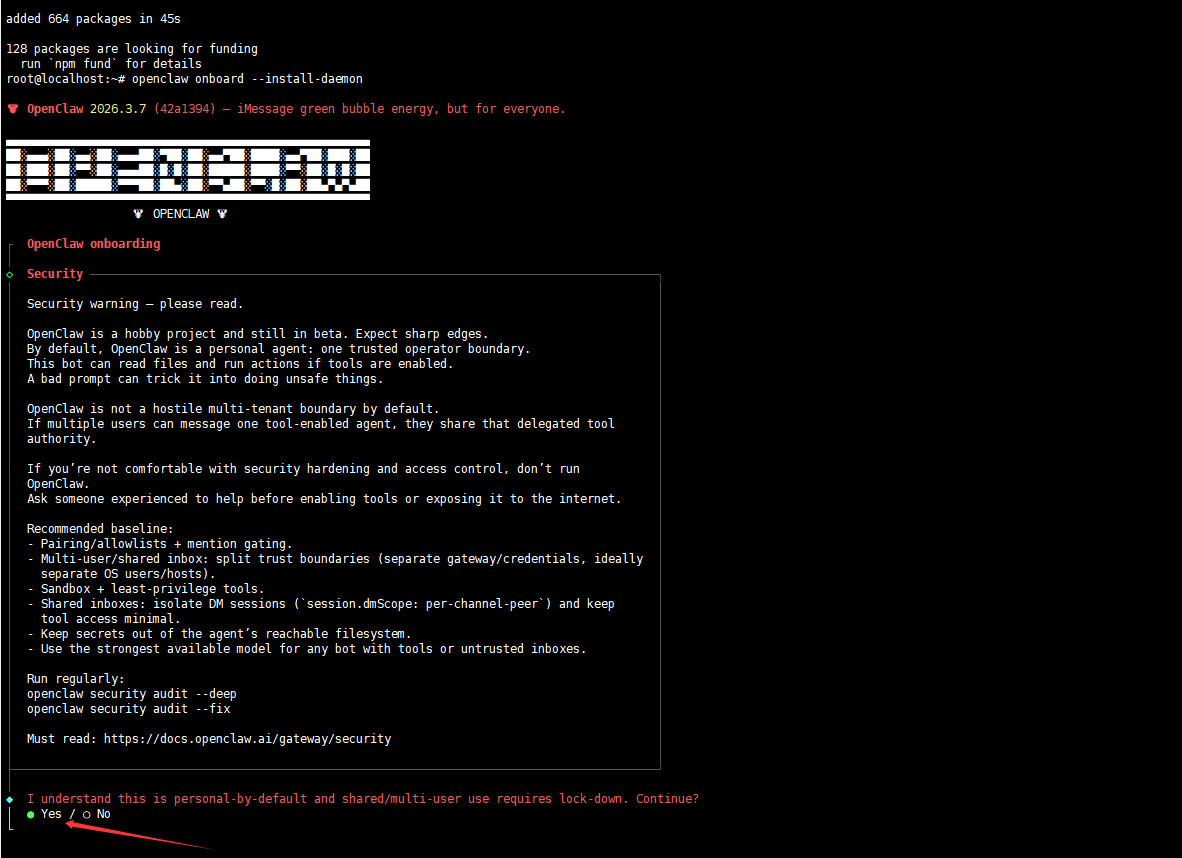

核心程序安装完毕后,我们需要通过原生命令拉起 OpenClaw 的初始化向导。这一步终端会弹出大量的英文交互选项,请严格按照下方拆解的步骤,一步步对照操作。

1. 拉起 Onboard 终端初始化引导

在终端输入以下命令并回车,启动配置流程并将其挂载为后台守护进程:

openclaw onboard --install-daemon2. 终端交互选项逐个配置(前半部分)

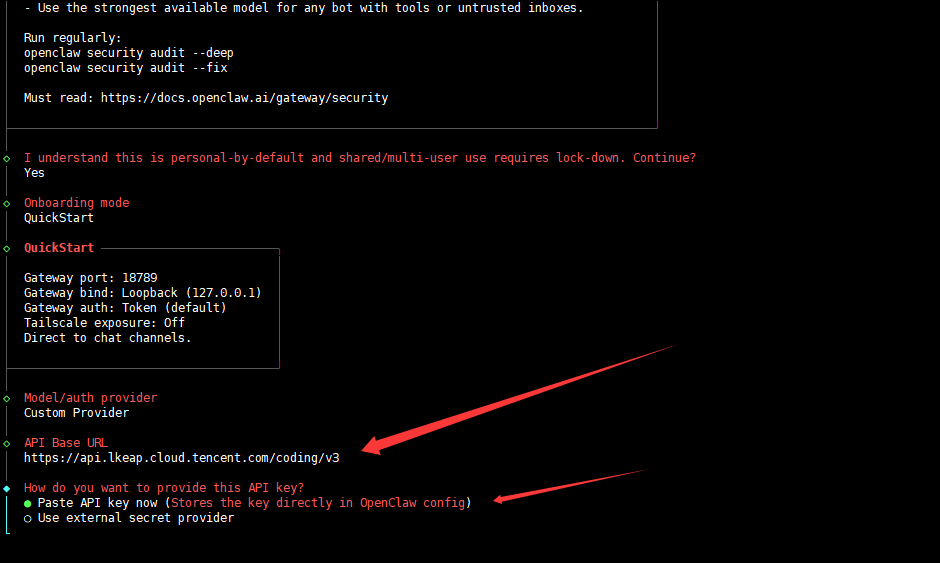

执行命令后,终端会依次弹出以下提示,请对照选择:

提示 1: I understand this is personal-by-default and shared/multi-user use requires lock-down. Continue? (我明白这是默认的个人账户,共享/多人使用需要锁定账户。继续吗?) 操作: 键盘左右键选择 Yes,回车。

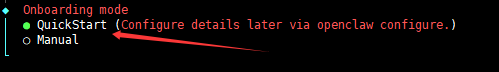

提示 2: Onboarding mode (新手引导模式) 操作: 选择第一项 QuickStart (Configure details later via openclaw configure.) 快速配置,回车。

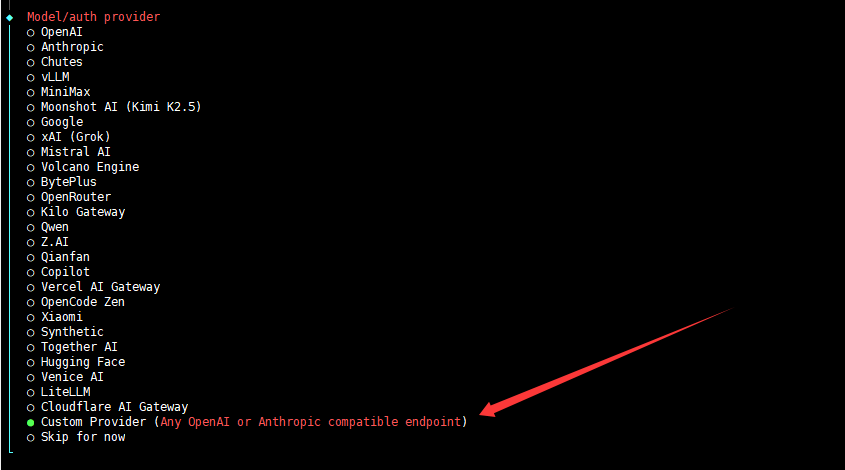

提示 3: Model/auth provider(选择模型提供商) 操作: 向下选择 Custom Provider (Any OpenAI or Anthropic compatible endpoint) 自定义提供商(任何与 OpenAI 或 Anthropico 兼容的端点),回车。

3. 中场插曲:获取高性价比大模型 API

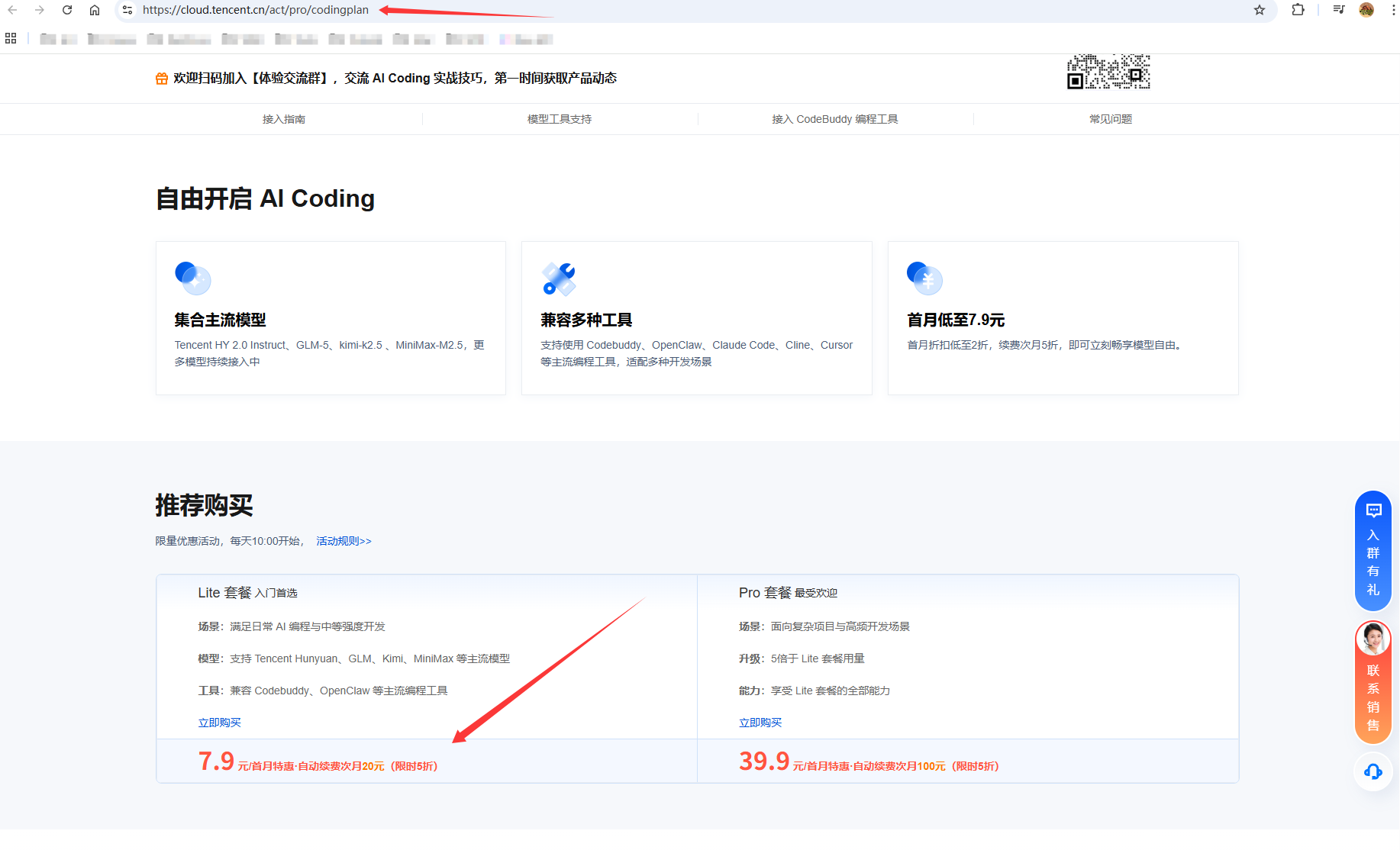

在进行下一步终端配置前,我们需要先准备好大模型的 API。对于 QQ 机器人日常交互,强烈推荐腾讯云新出的 CodingPlan Lite 套餐(7.9元/月),每天上午十点开售,性价比极高。

动作一:选购套餐 打开腾讯云活动页 https://cloud.tencent.cn/act/pro/codingplan 完成选购。

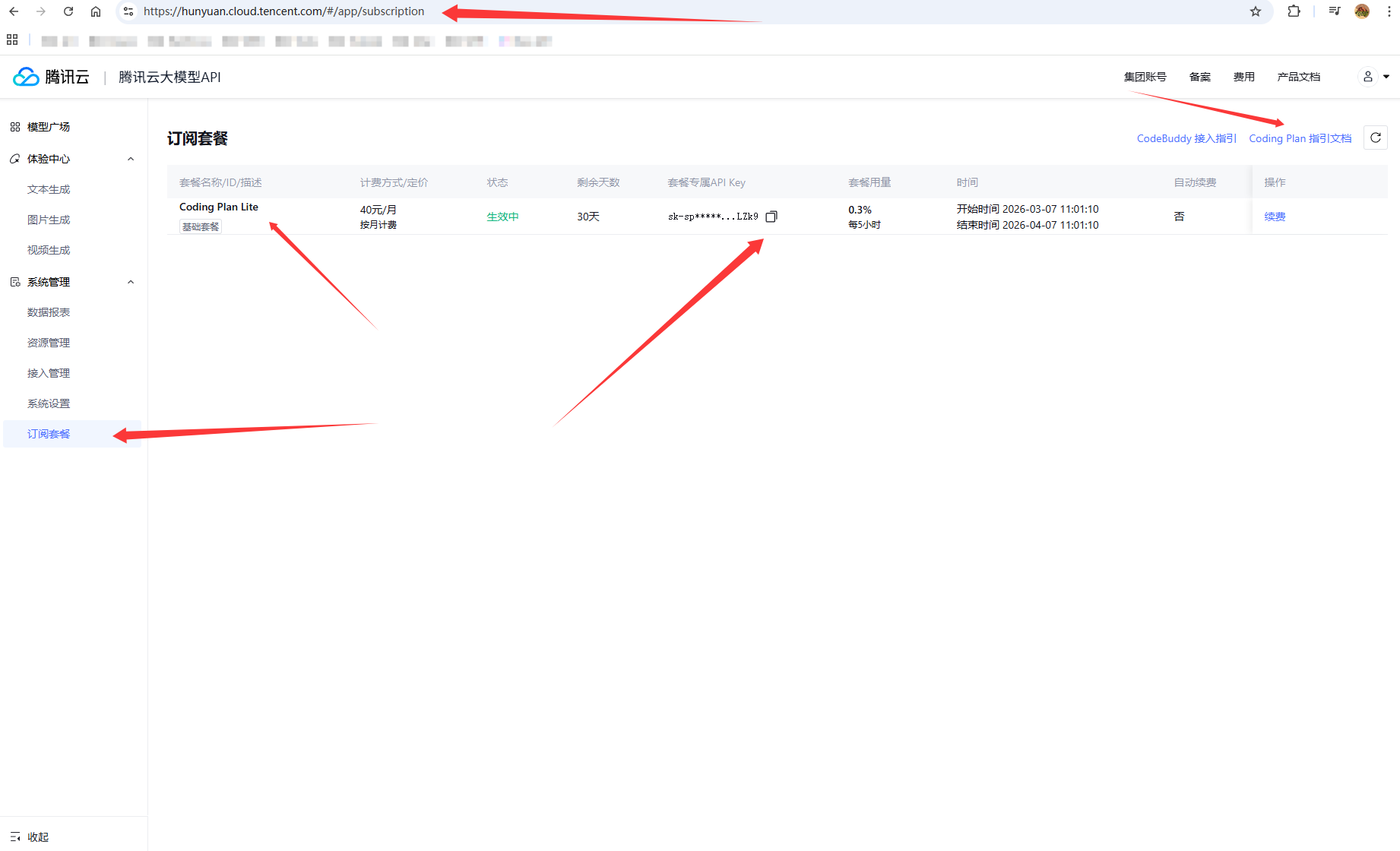

动作二:获取 API Key 进入后台页面 https://hunyuan.cloud.tencent.com/#/app/subscription,点击左侧的“订阅套餐”,复制并保存你的 API Key。

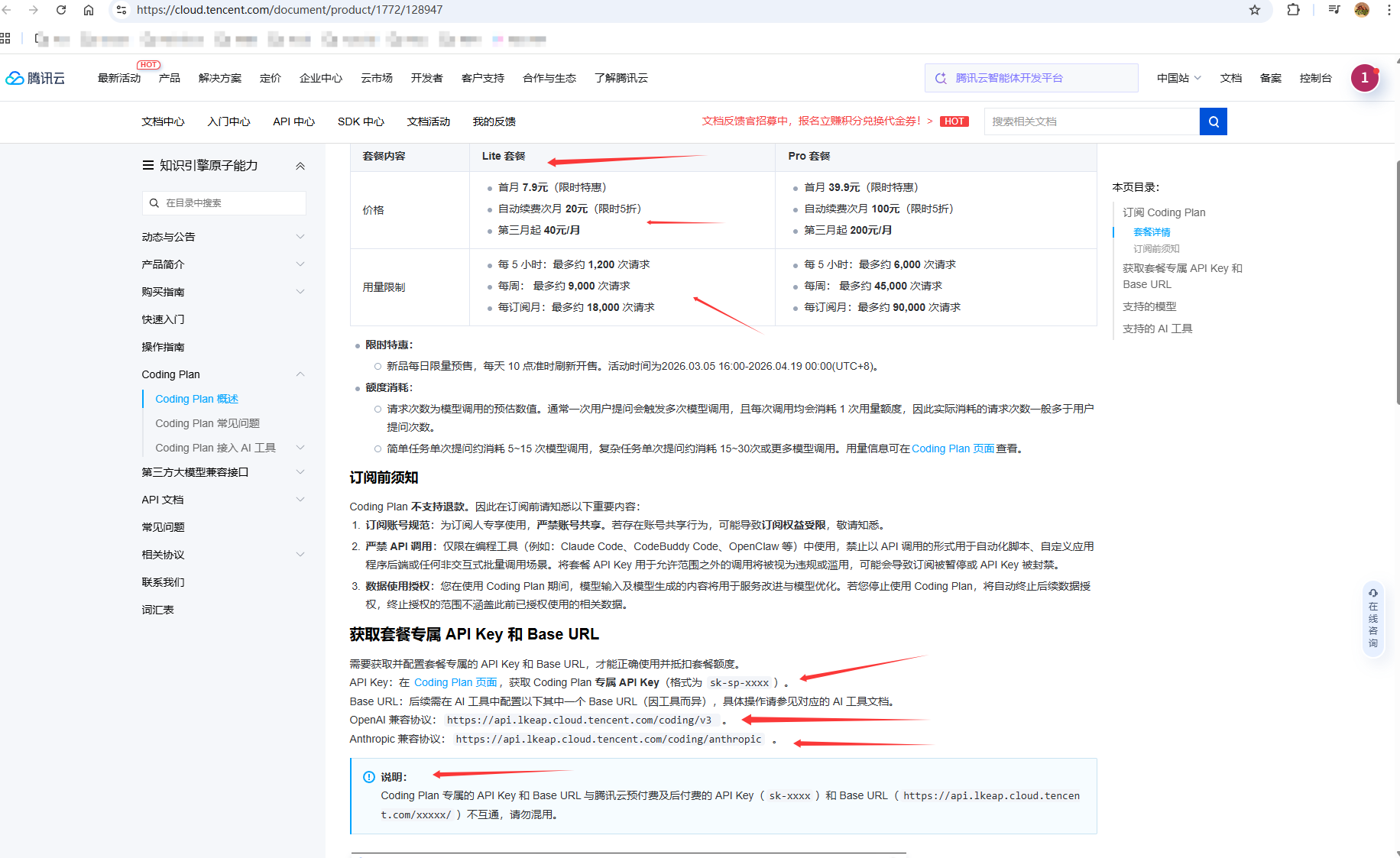

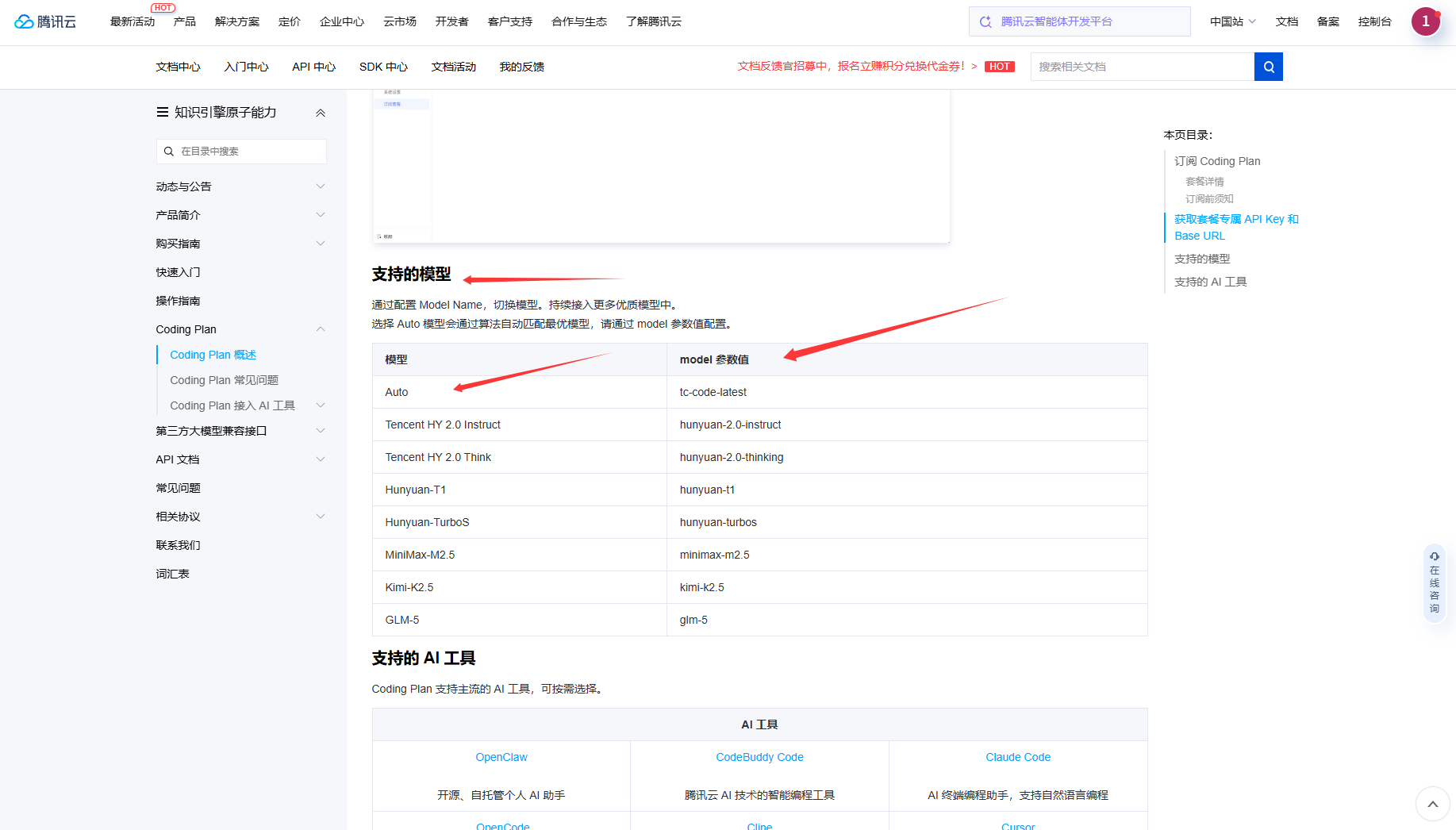

动作三:获取 Base 地址 点击右上角的“Coding Plan 指引文档”(或访问 https://cloud.tencent.com/document/product/1772/128947),向下翻找到 Lite 套餐专属的 OpenAI 兼容协议 Base URL:https://api.lkeap.cloud.tencent.com/coding/v3。同时记下支持的模型名称,例如 tc-code-latest。

4. 终端交互选项逐个配置(后半部分参数注入)

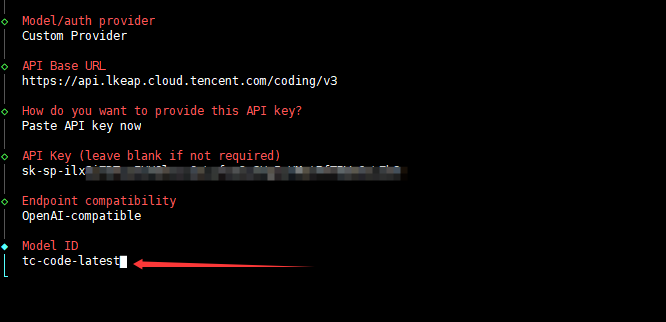

拿到 API 信息后,我们回到终端继续填入参数:

提示 4: API Base URL (API链接地址) 操作: 先删除终端里的默认值,然后粘贴刚刚获取的 https://api.lkeap.cloud.tencent.com/coding/v3,回车。

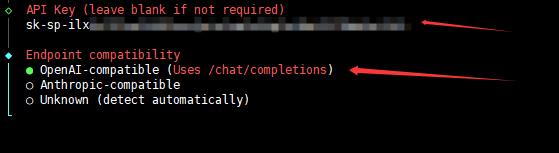

提示 5: How do you want to provide this API key? (您希望如何提供此 API 密钥?)操作: 选择 Paste API key now,(立即粘贴 API 密钥)随后把你复制的腾讯云 API key 粘贴进去,回车。

提示 6: Endpoint compatibility(选择兼容协议) 操作: 刚才复制的是 OpenAI 兼容协议,所以这里选择第一项 OpenAI-compatible (Uses /chat/completions) (兼容 OpenAI(使用 /chat/completions)),回车。

提示 7: Model ID (模型ID 名称)操作: 输入从文档获取的模型名称 tc-code-latest,回车。

提示 8: Endpoint ID (端点ID) 操作: 系统通常会自动解析,直接回车即可。

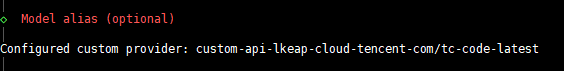

提示 9: Model alias (optional)(可选模型别名) 操作: 不需要设置,直接回车。

5. 跳过非必要扩展,规避下载报错

接下来的几个选项属于进阶扩展功能,由于网络环境等问题容易导致下载报错卡死,强烈建议新手全部跳过,等后续跑通了再按需配置。

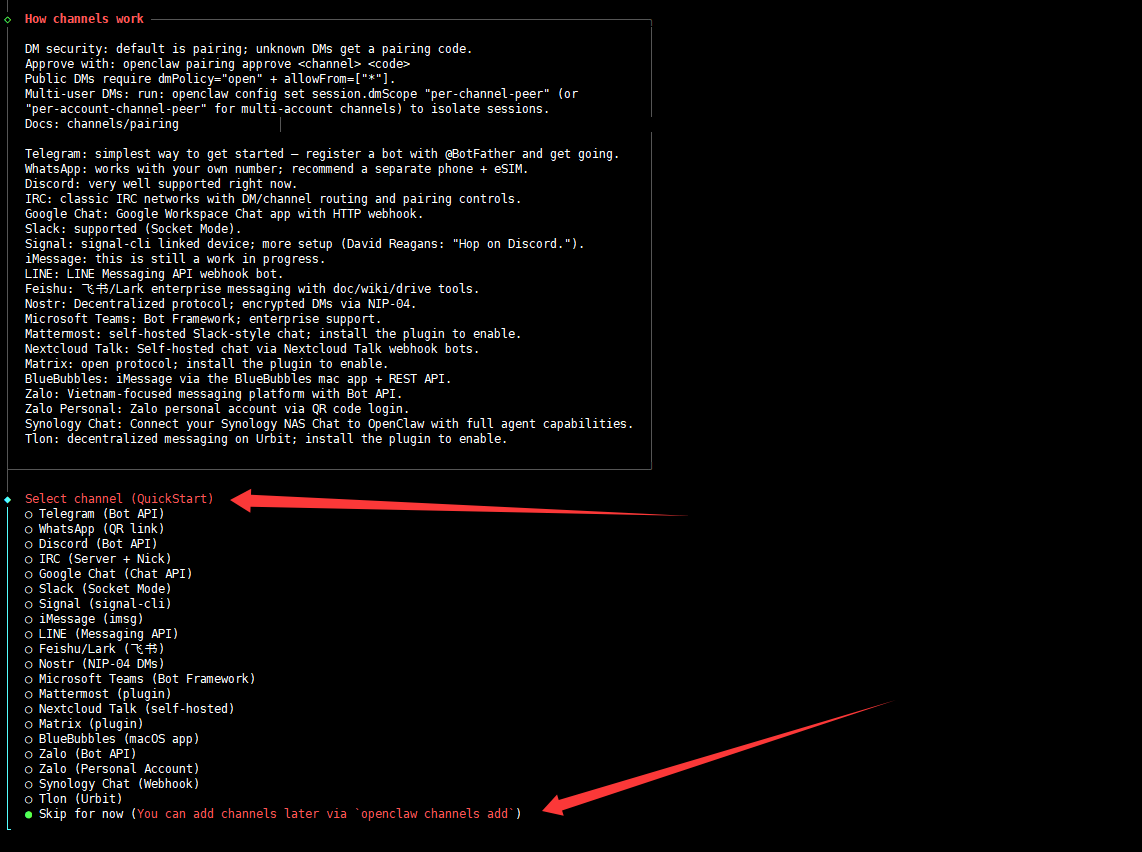

提示 10: Select channel (QuickStart)(通知渠道) 操作: 选择最下面一个 Skip for now,回车。

提示 11: Search provider(网络搜索提供商) 操作: 选择最后一个 Skip for now,回车。

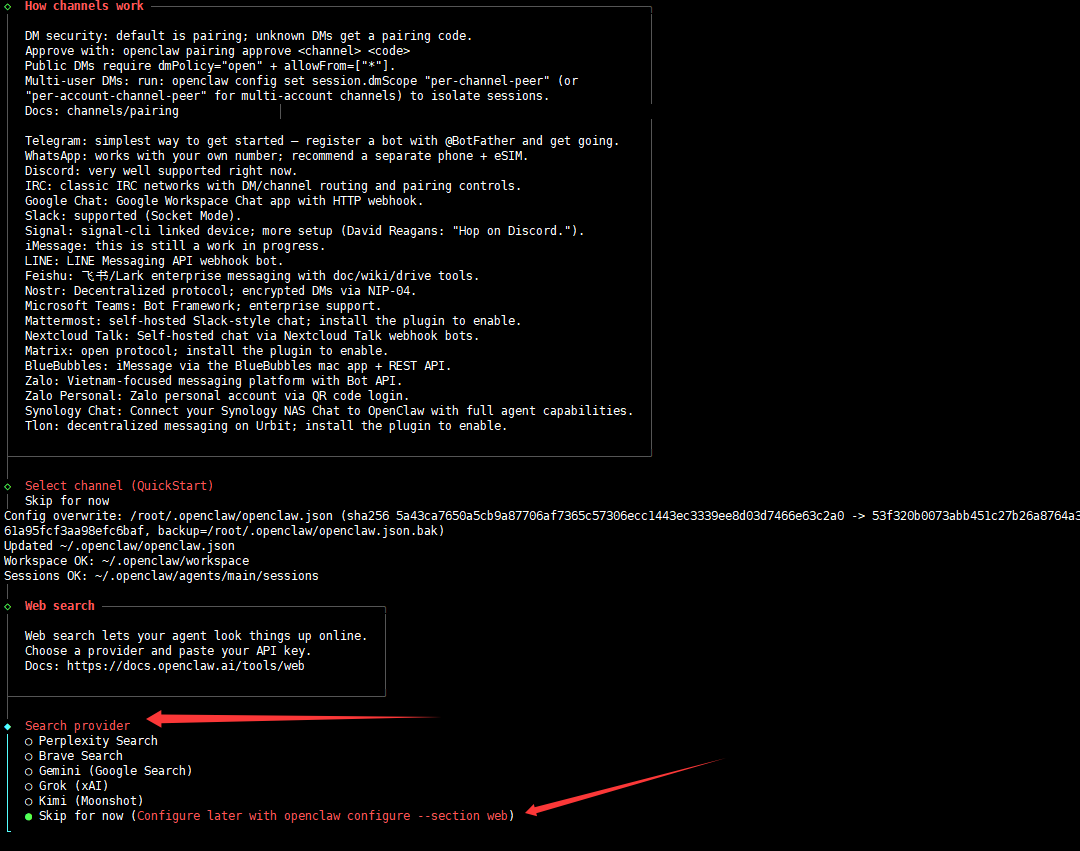

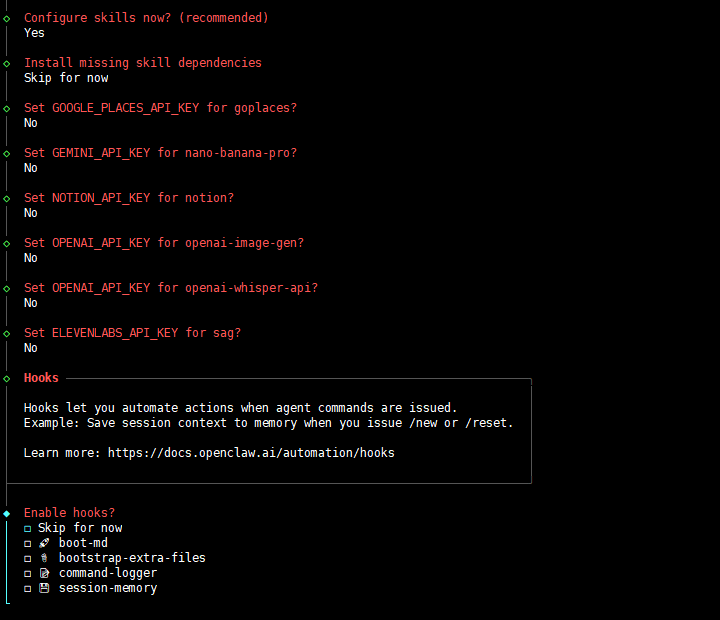

提示 12 与 13: Configure skills now? / Install missing skill dependencies(技能与依赖)

提示 14: Enable hooks? (开启钩子)操作: 选择 Skip for now 跳过。 操作: 这里非常重要!直接一路选 No 或者 Skip for now (跳过)。如果不跳过,极易出现各种下载失败和报错。

6. 选择运行模式并完成最终验证

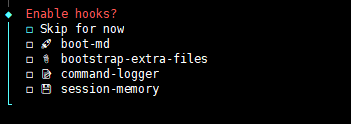

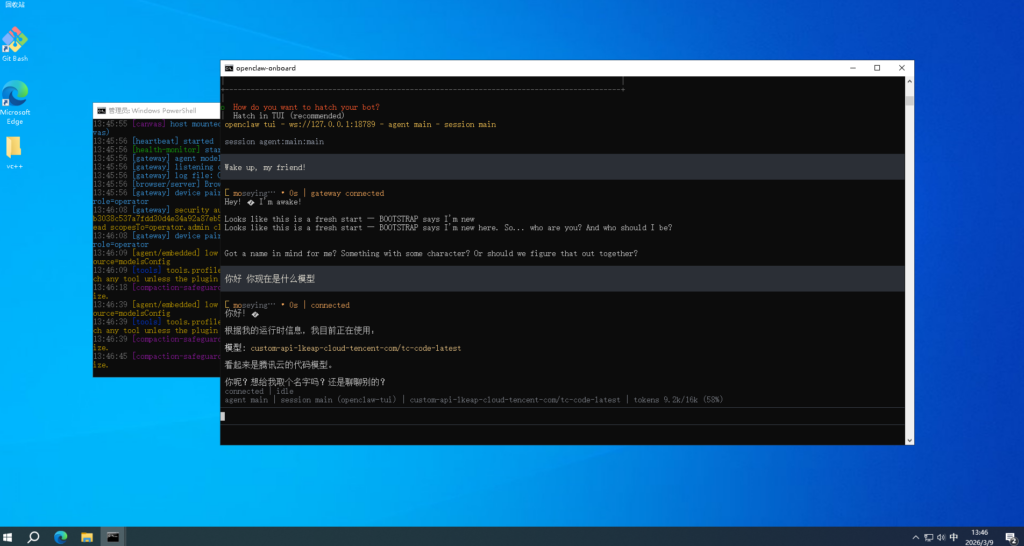

提示 15: How do you want to hatch your bot? (你想怎么运用你的机器人)(操作: 强烈建议选择第一项 Hatch in TUI (recommended) (TUI命令模式推荐),回车。

⚠️ 防坑提示: 千万不要选第二个 Open the Web UI!因为 Web 界面默认不开放外网和端口访问,除非你去修改系统网络配置或套用 Nginx 反向代理,否则根本打不开。选择 TUI(终端用户界面)是最稳妥的做法。

最终验证: 配置完成后,终端会自动进入 TUI 聊天界面。在底部的输入框内向 AI 提问测试,如果能收到正常的回答,说明我们的大模型对接已经完美成功!

第四章:获取 QQ 机器人专属配置与 OpenClaw 终端对接

大模型底层跑通后,最后一步就是将这个“大脑”接入 QQ 渠道。借助 QQ 开放平台提供的专属通道,我们可以极速完成机器人的注册与绑定。

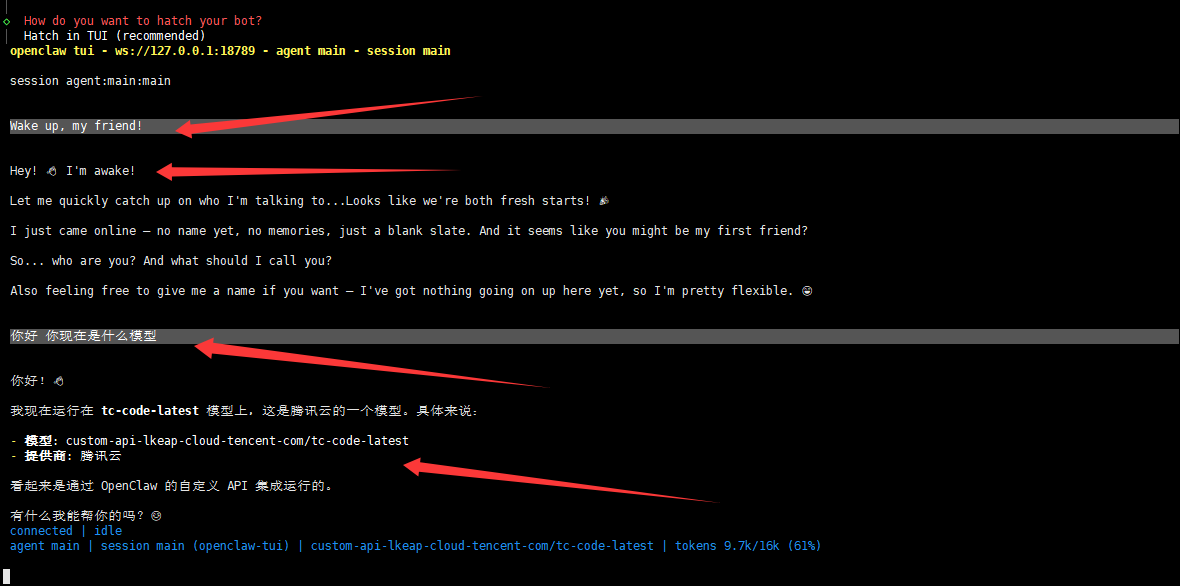

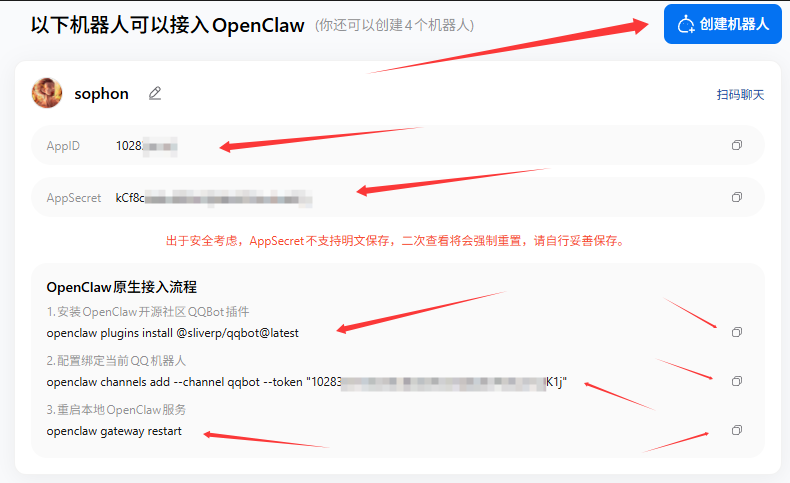

1. 申请 QQ 机器人专属通道

打开浏览器,访问 QQ 开放平台官方网站(https://q.qq.com/)。 在平台首页或控制台中,找到并点击 openclaw 龙虾专用入口(这是官方提供的快速接入通道)。 点击“去使用”后,根据页面提示填写相关基础信息,自行完成机器人的注册流程。

2. 获取并保存核心配置信息

注册完成后,如果配置页面意外消失或关闭,无需重新注册。再次点击刚才的“龙虾专用入口”,即可直接获取到该机器人的详细配置信息。 请将页面上显示的所有配置参数(如 AppID、Token 等)全部复制,并妥善保存到本地备用。

3. 扫码添加机器人至联系人

在配置信息页面下方,找到并点击“扫码聊天”按钮。 使用你的手机 QQ 扫描弹出的二维码,将刚刚创建好的 QQ 机器人直接添加到你的好友列表或测试群组中,为后续的对话测试做准备。

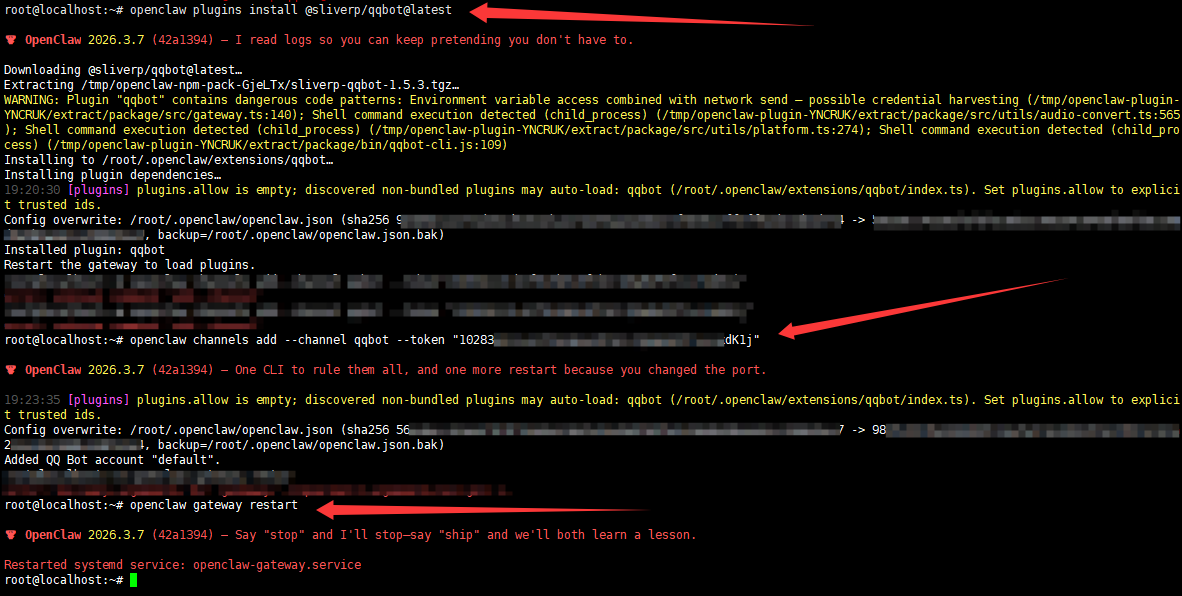

4. 终端安装 QQ 插件与重启服务

拿到配置信息后,返回服务器的 SSH 终端。 在终端中依次执行 QQ 机器人插件的安装命令、绑定刚才获取到的配置参数,并最终重启 OpenClaw 服务使配置生效。

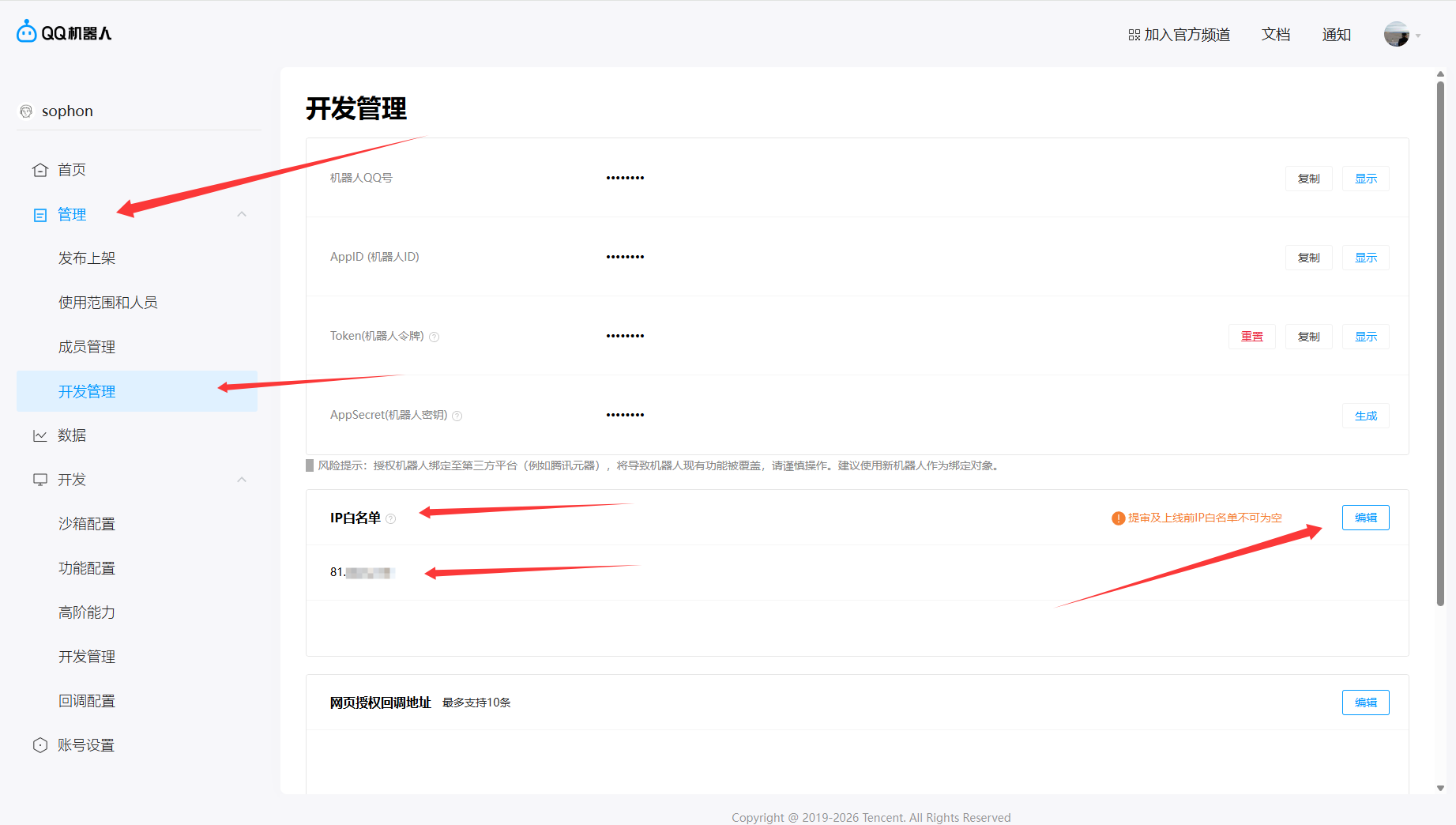

5. 配置服务器 IP 白名单

⚠️ 核心防坑: 为了确保 QQ 服务器能与我们的节点正常通信,必须放行服务器的公网 IP。 返回 QQ 开放平台后台,依次点击 管理 -> 开发管理。 在设置页面中找到 IP 白名单 选项,填入你当前这台服务器的公网 IP 地址,点击保存即可生效。如果不填这一步,机器人将无法接收和发送任何消息。

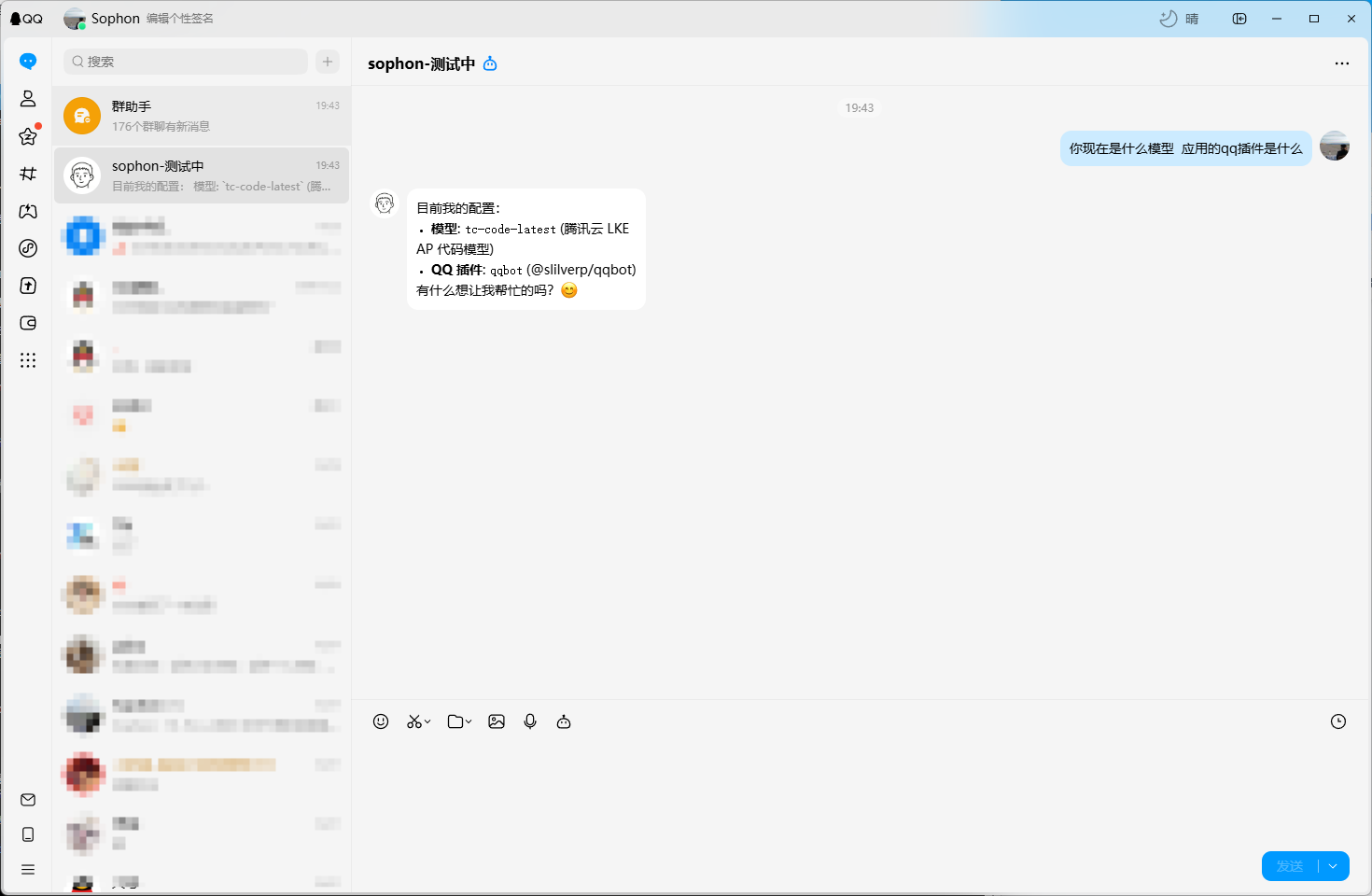

6. 最终全链路对话测试

白名单生效后,打开你的手机或电脑 QQ。 进入刚才添加的 QQ 机器人聊天窗口,随意输入并发送一段文字。只要机器人能够结合我们第三章配置的腾讯混元大模型给你做出准确回复,即代表整个原生环境部署与 QQ 对接实战圆满成功!

第四章:Windows 节点原生环境直装与本地 Web 面板接管

如果你打算在 Windows 服务器或本地 Windows 物理机上原生拉起 OpenClaw 小龙虾,底层的依赖准备会与 Linux 有所不同。本章将带你完成 Windows 环境下的防坑直装,并直接利用桌面系统的优势开启 Web UI 控制面板。

1. 补齐 Windows 底层 C++ 运行库(硬性前置要求)

⚠️ 致命避坑提示: Windows 系统默认往往缺失最新的 C++ 运行库。如果不提前安装,后续运行 Node.js 底层扩展或拉起大模型服务时会直接弹出各种 .dll 文件缺失的报错。这是必须跨过的第一道门槛。

下载与安装: 打开微软官方支持页面 https://learn.microsoft.com/zh-cn/cpp/windows/latest-supported-vc-redist?view=msvc-170。 将页面中 2005-2026 最新支持的 x86 和 x64 版本全部下载一遍。下载完成后,双击依次安装完毕即可。

2. 部署 Git 版本控制工具

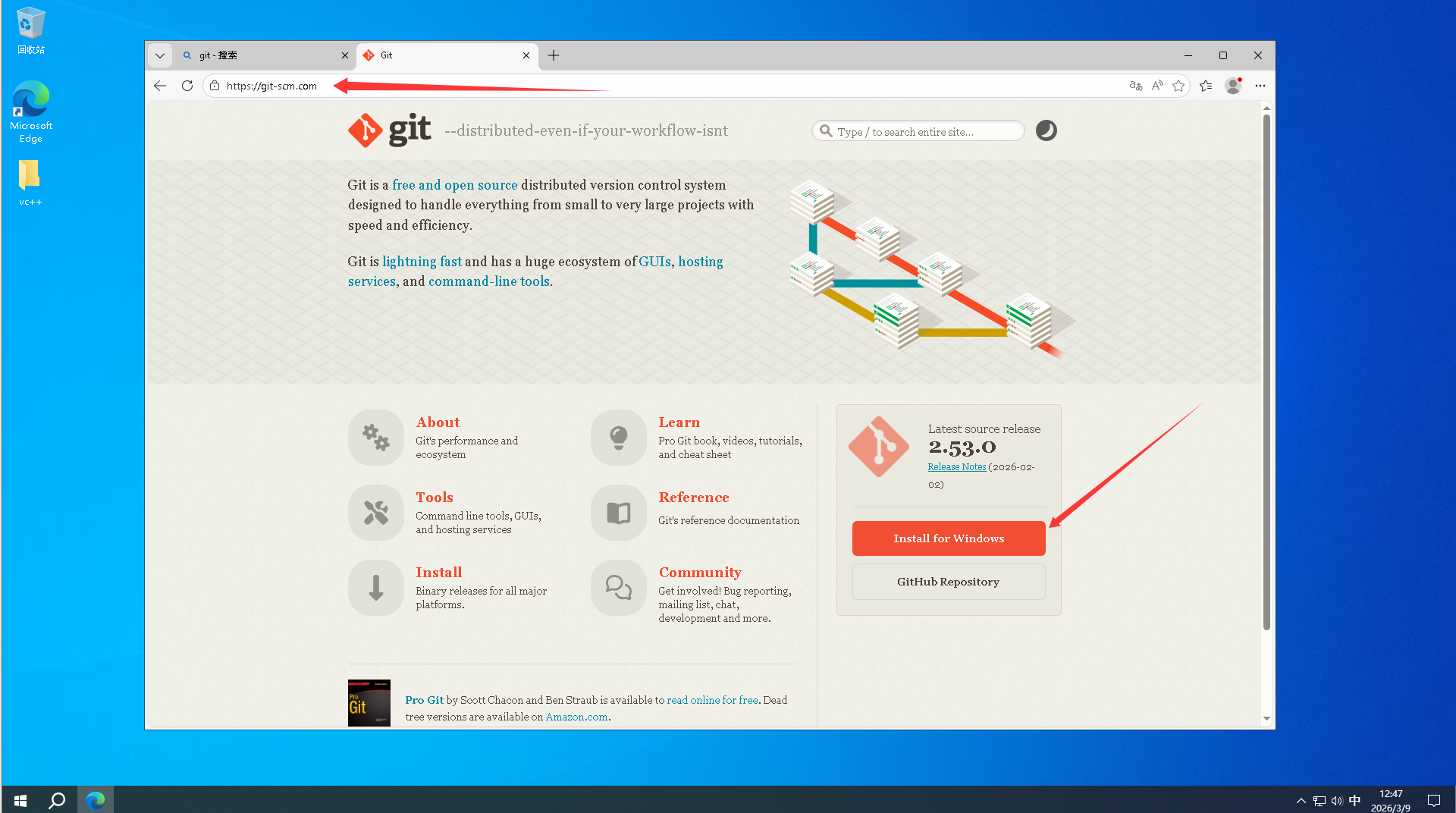

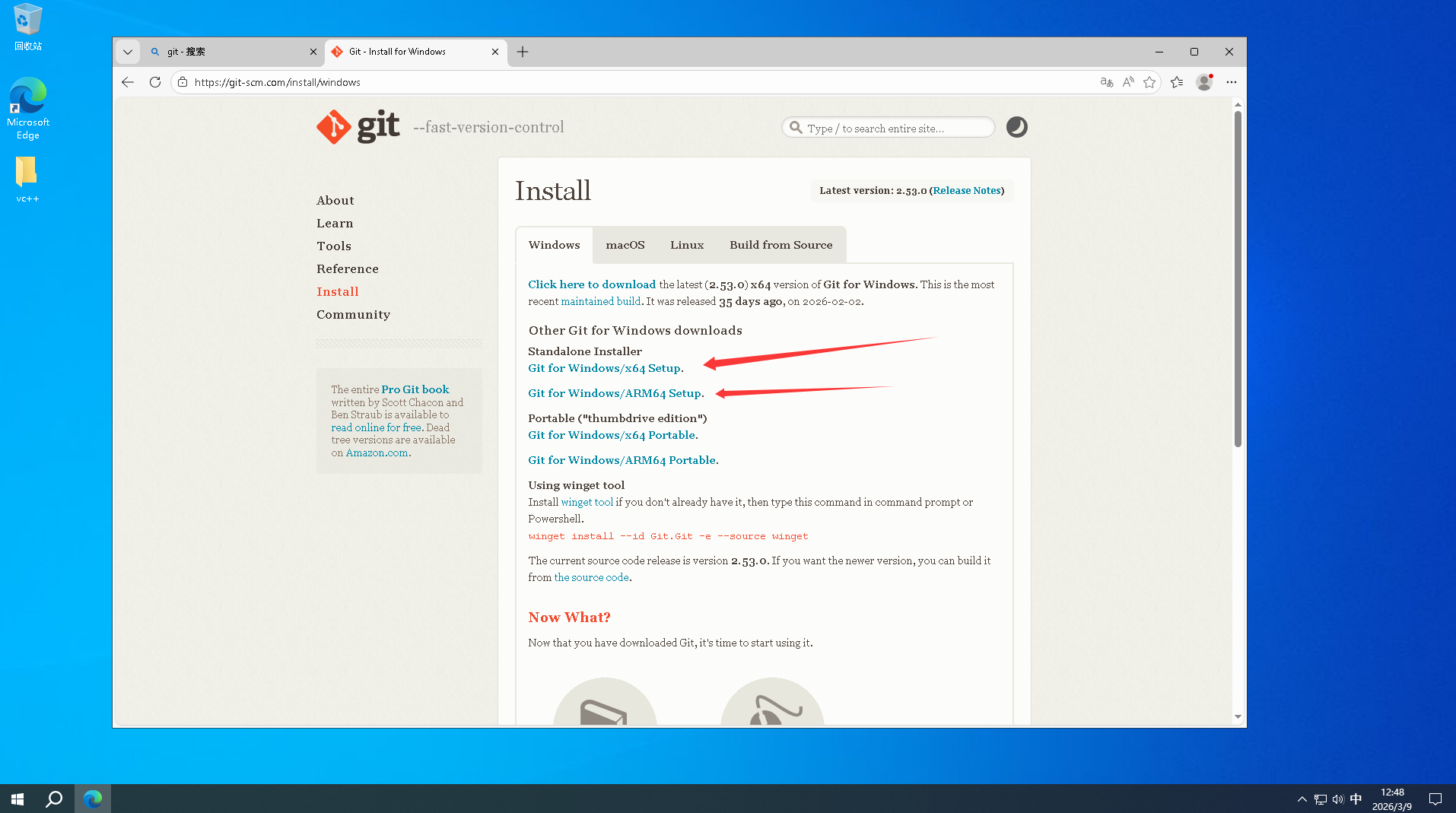

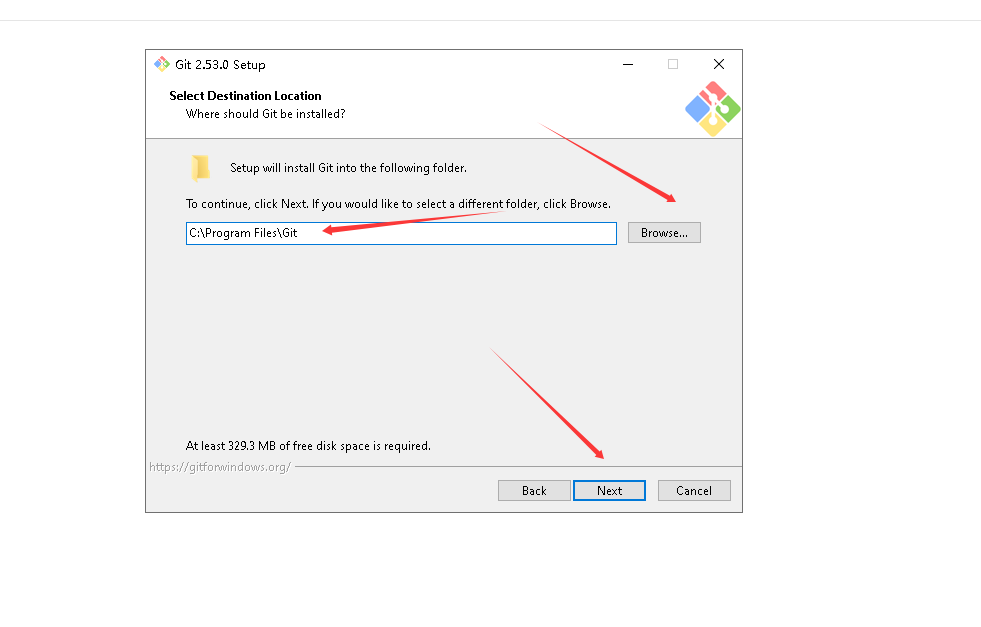

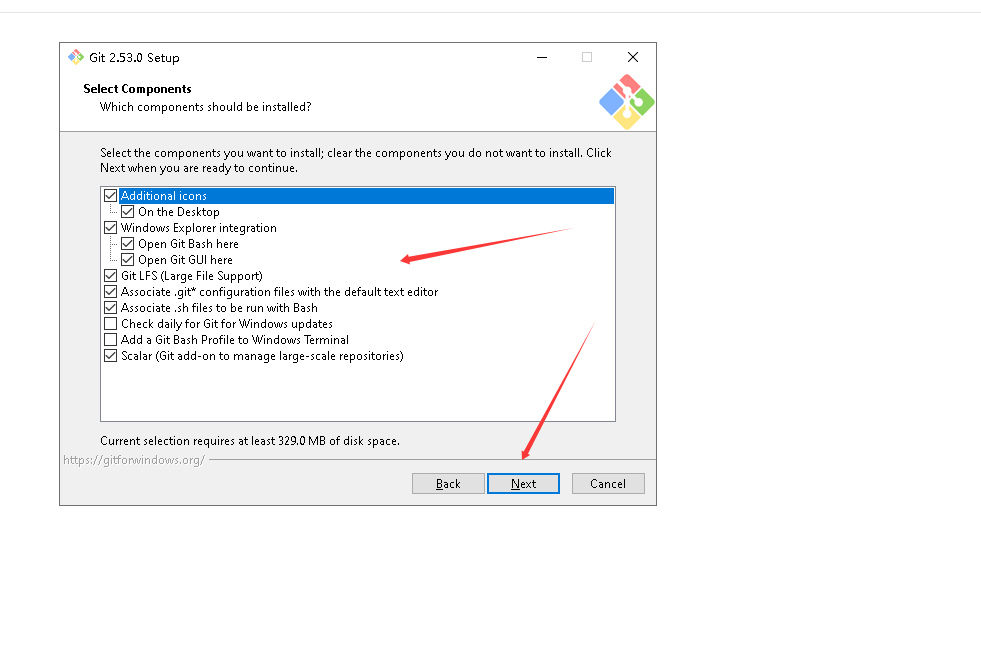

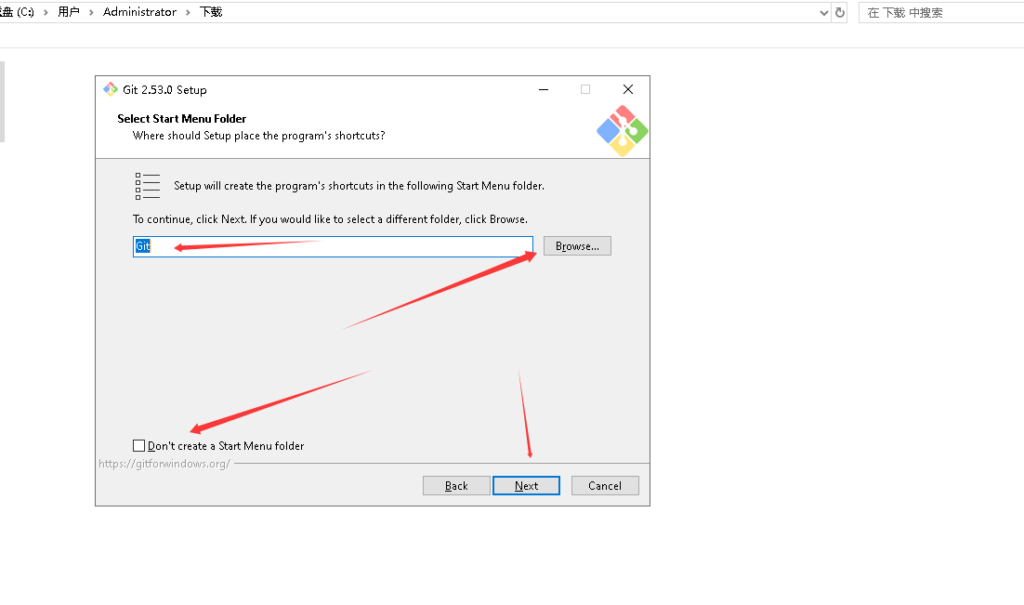

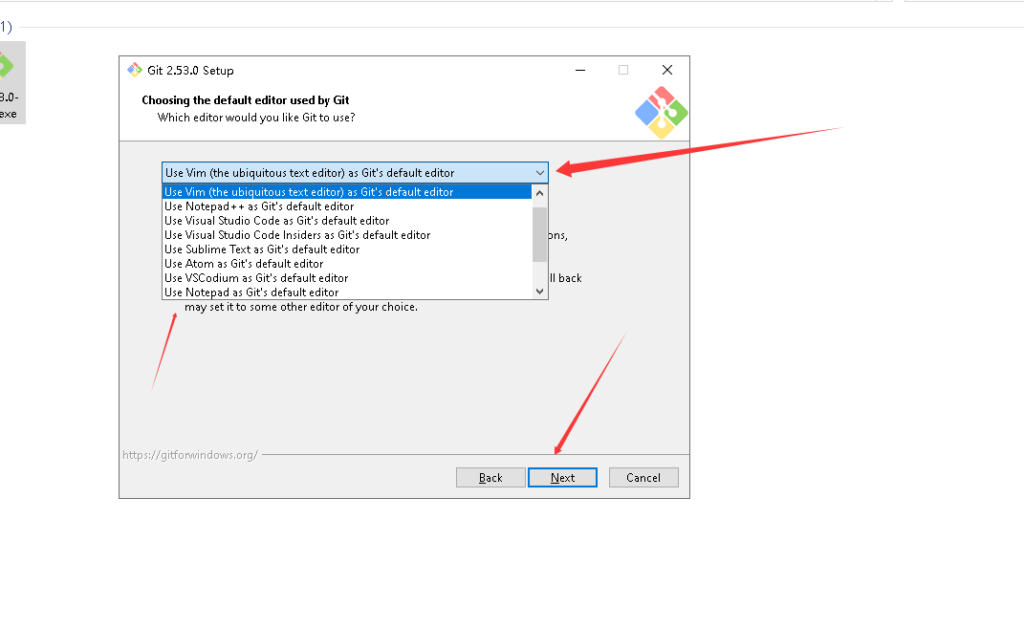

获取安装包: 打开 Git 官方网站 https://git-scm.com/,点击页面上的橙色按钮 Install for Windows。 进入下载页面后,选择 Git for Windows/x64 Setup(如果是 ARM 架构的设备则选择 ARM64 Setup)。

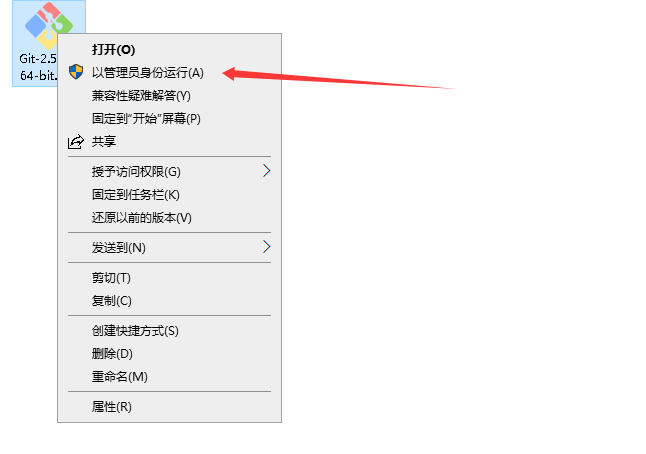

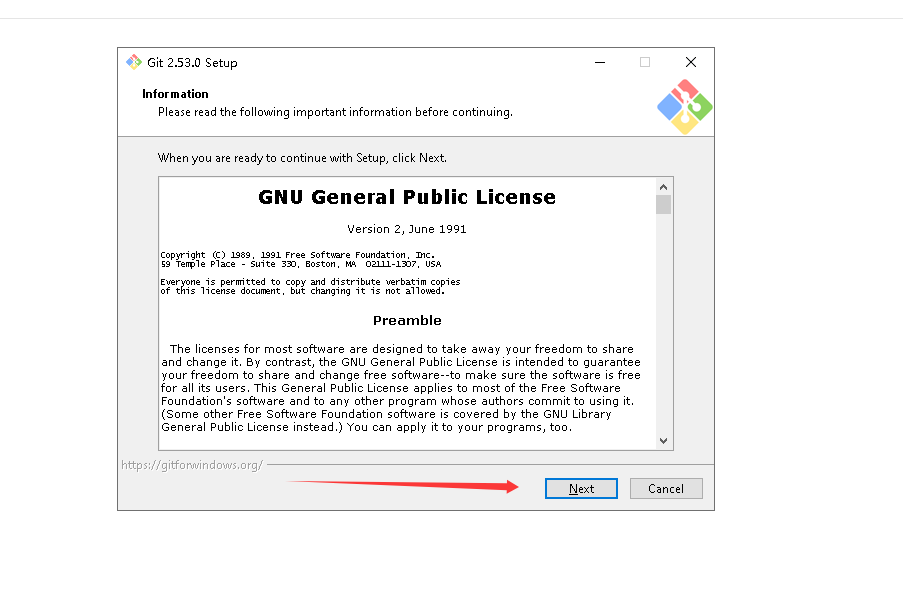

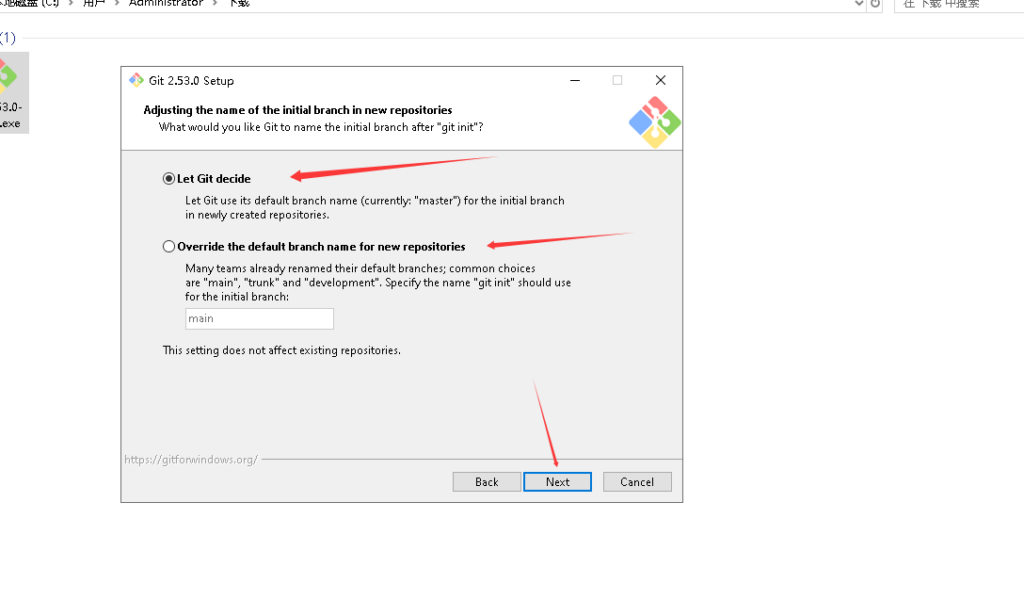

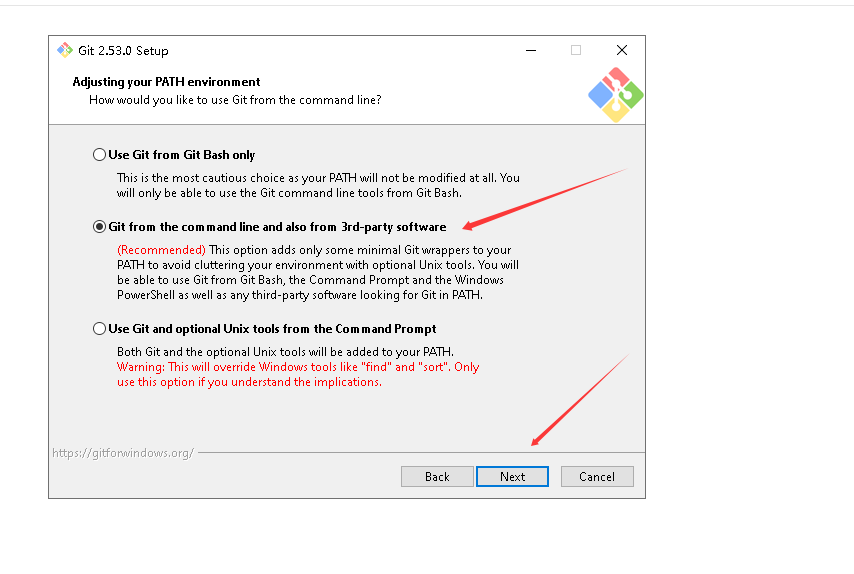

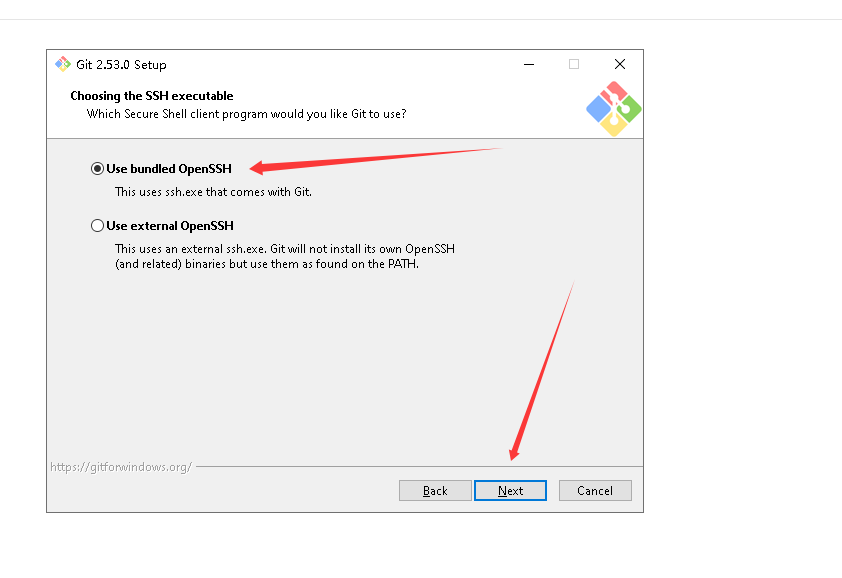

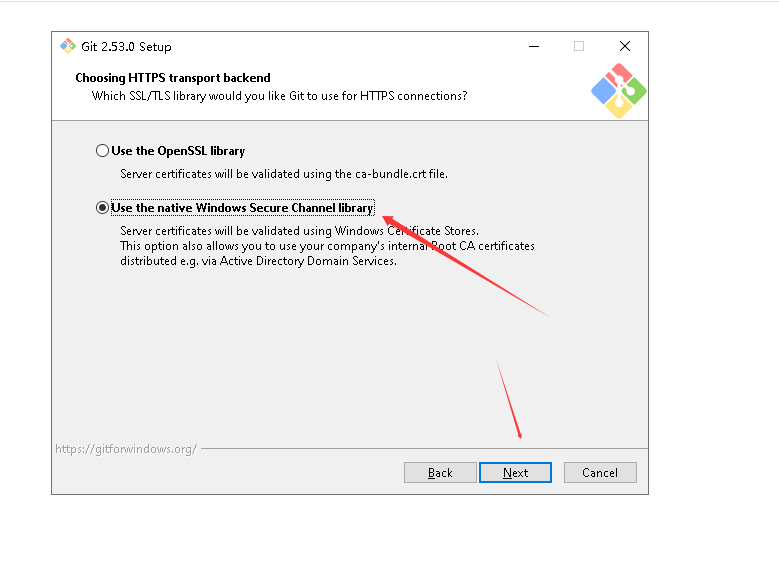

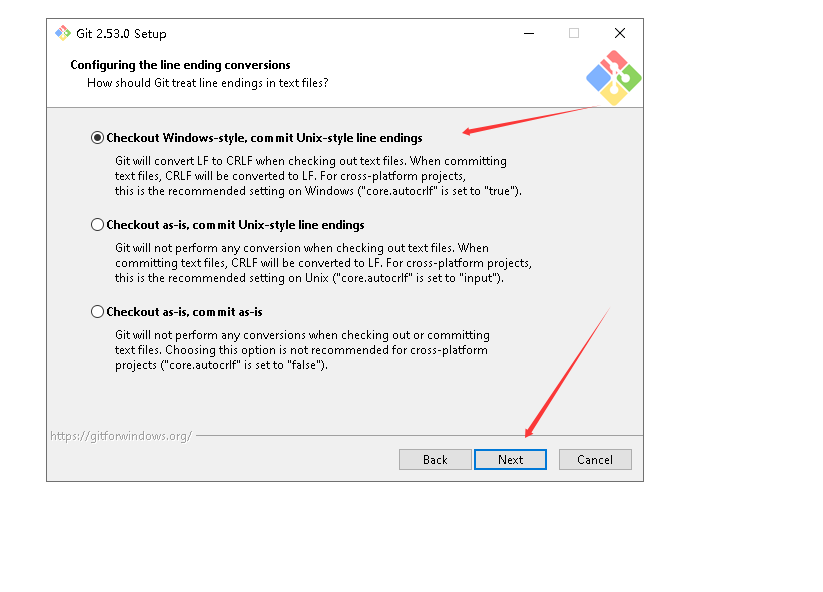

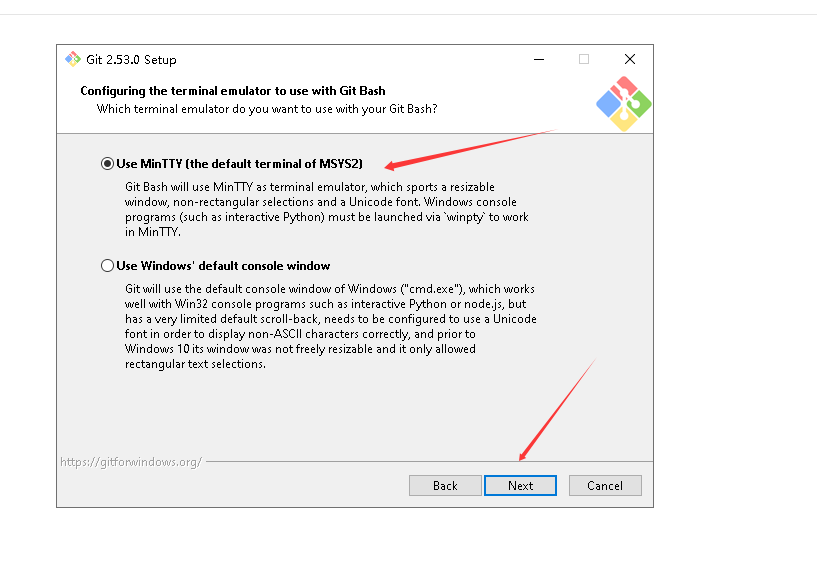

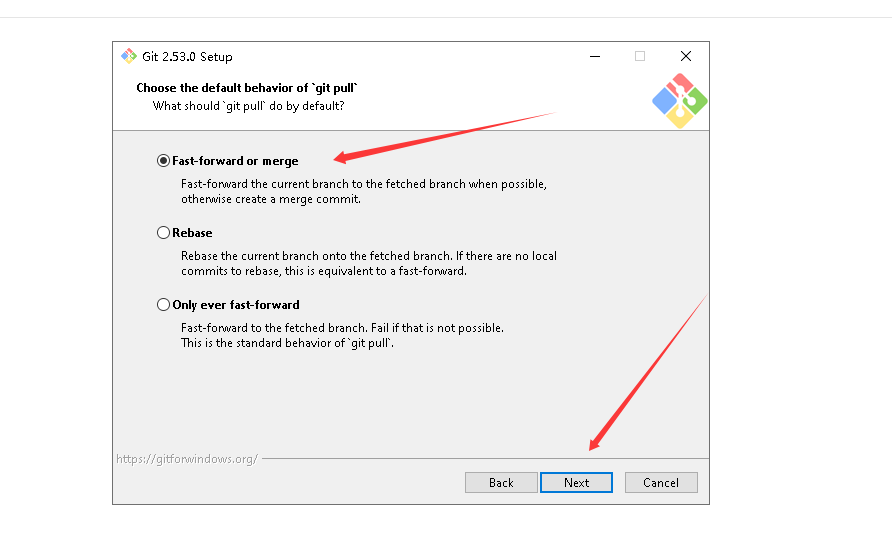

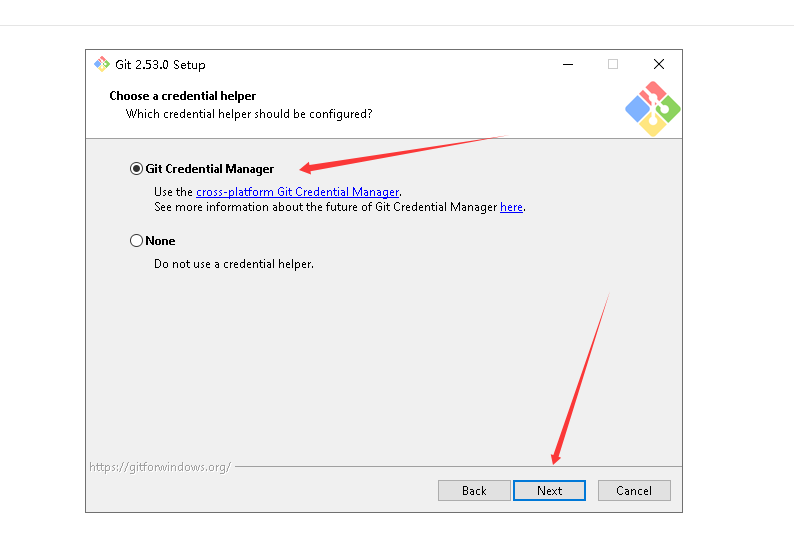

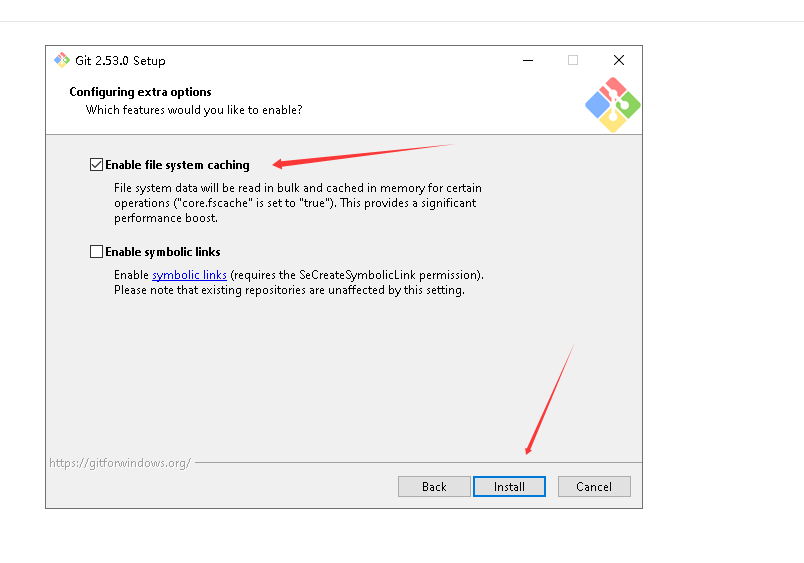

执行安装: 下载完成后,不要直接双击打开!找到该安装包,右键选择“以管理员身份运行”。 安装过程非常简单,如果不需要修改安装路径,直接一路点击 Next(下一步)保持默认选项走完即可。

3. 部署 Node.js 环境与安装“防坑”

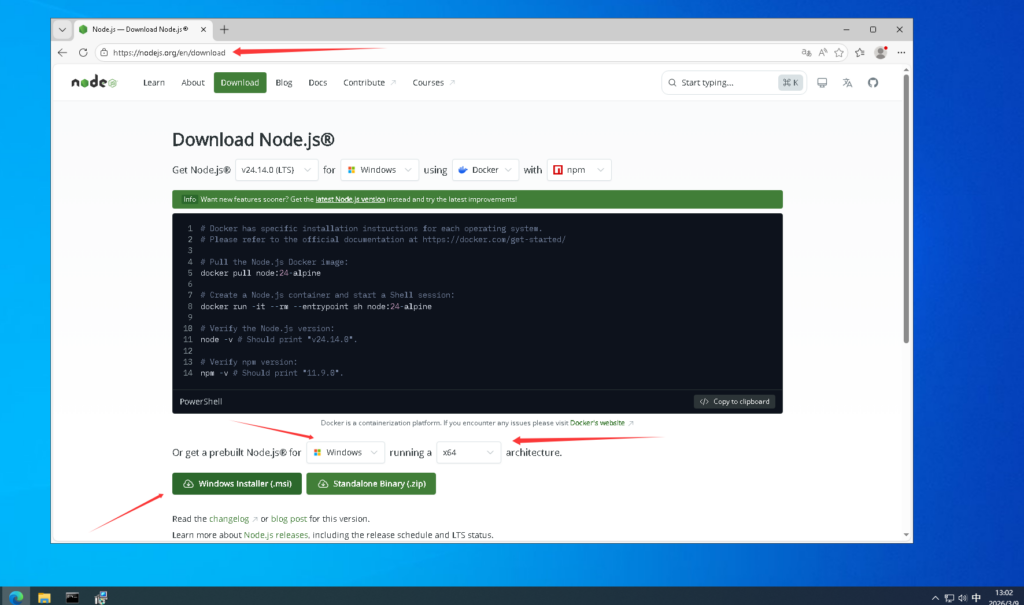

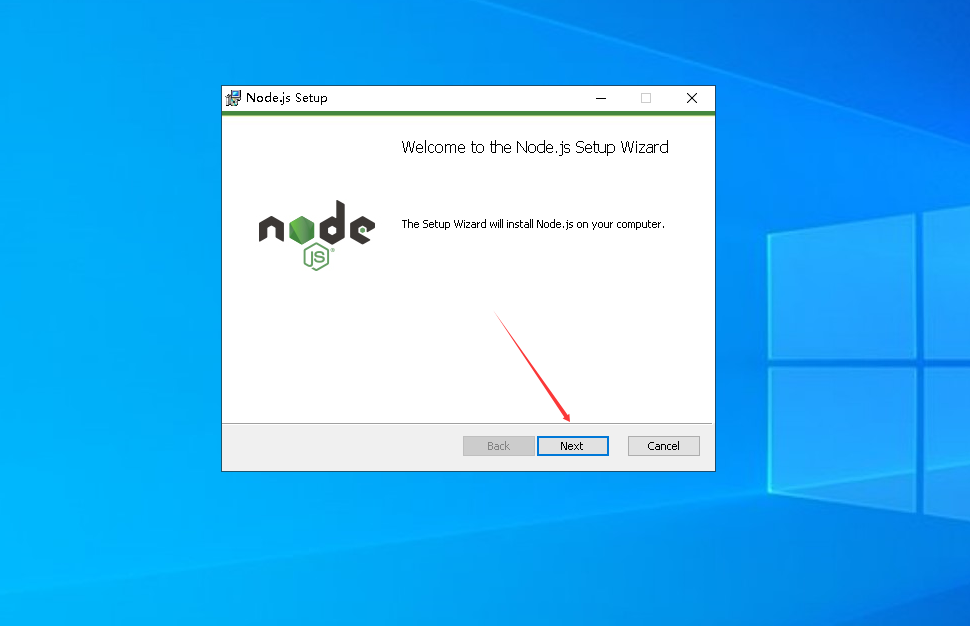

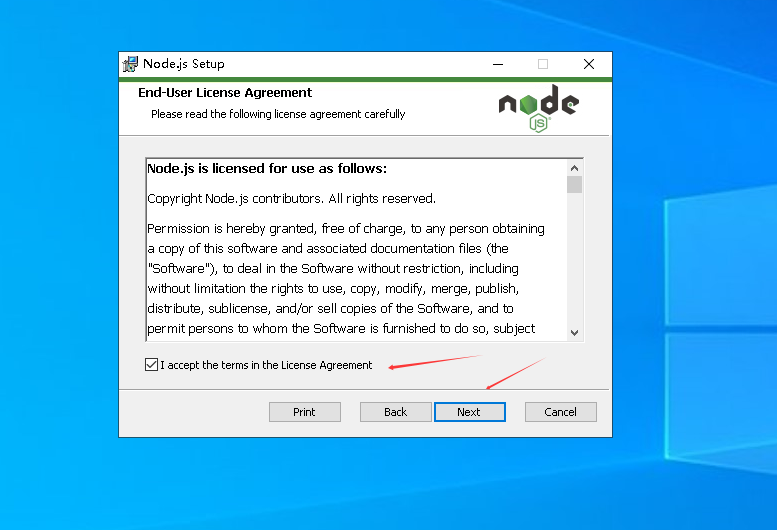

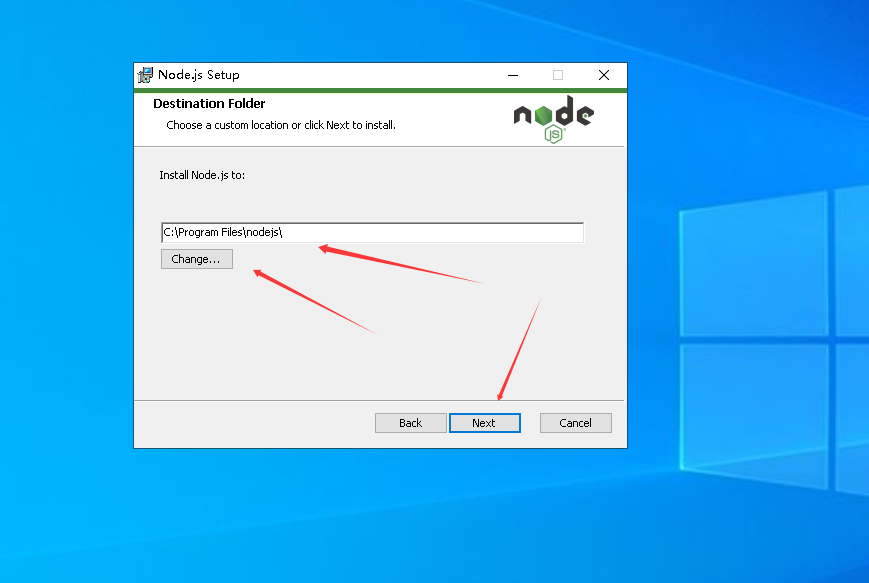

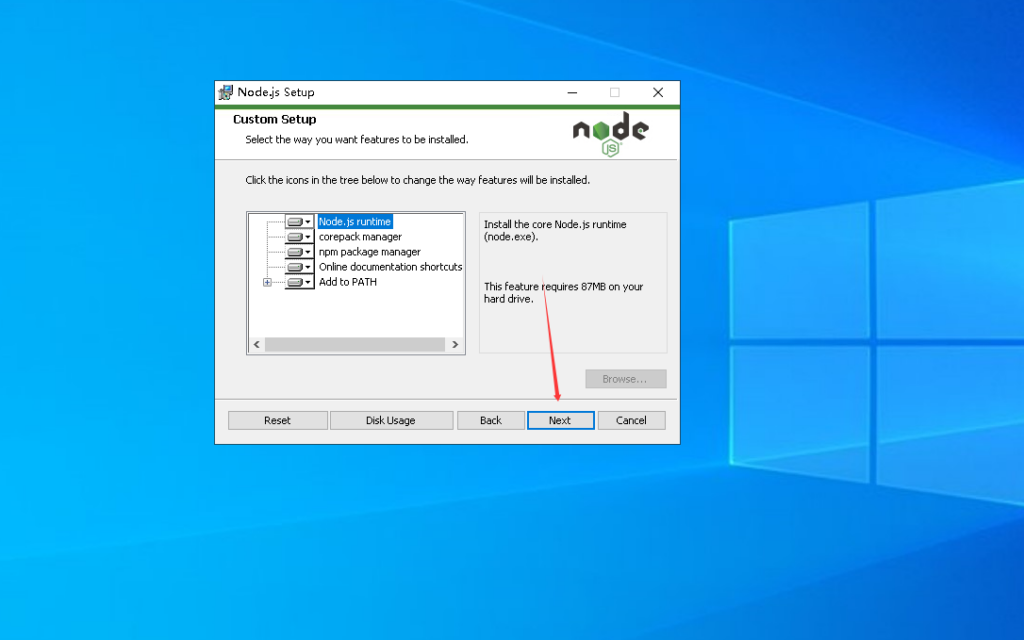

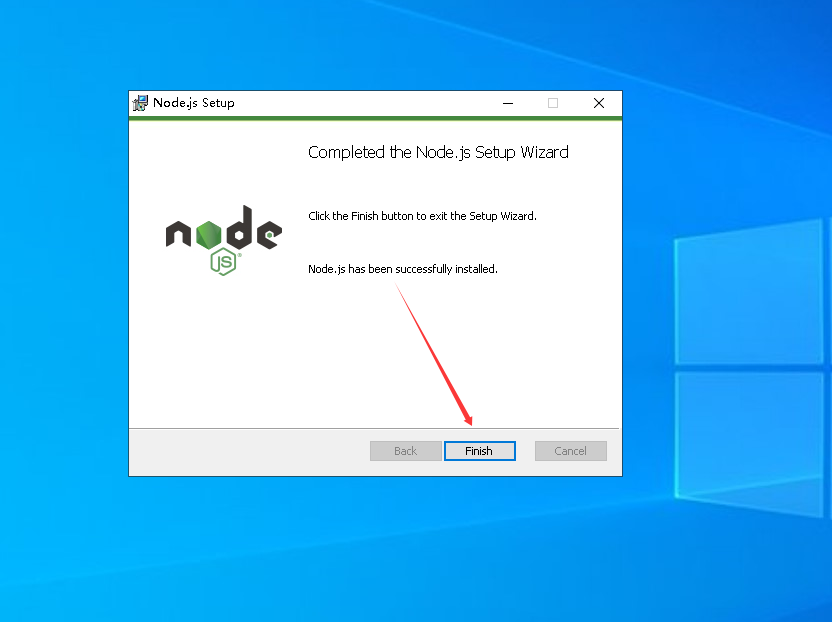

获取原生安装包: 打开 Node.js 官方网站 https://nodejs.org/,点击绿色按钮 Get Node.js®。 在下载界面向下滚动,找到 Or get a prebuilt Node.js® 区域,点击 Windows Installer (.msi) 下载系统对应的安装包。

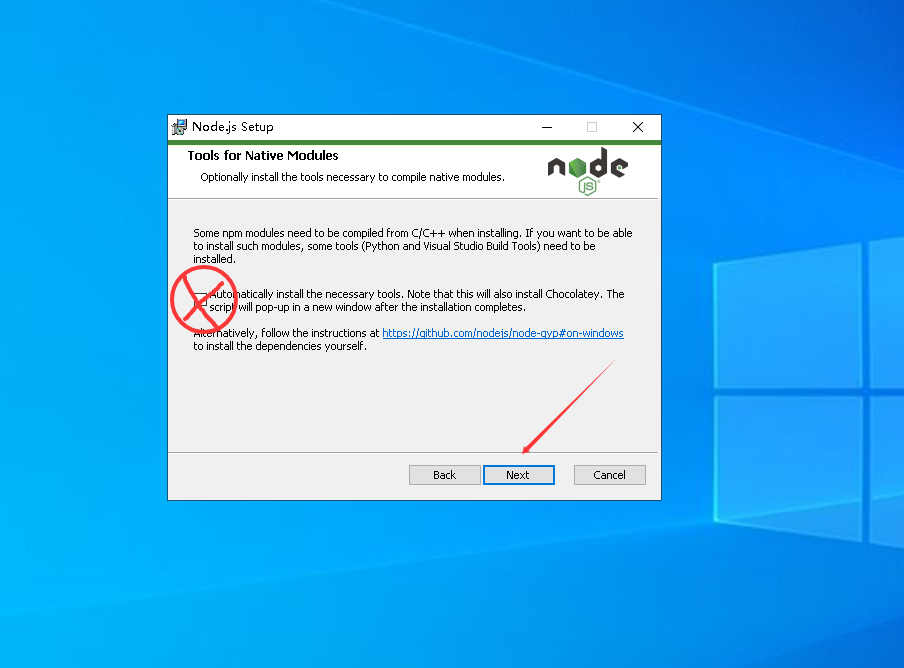

⚠️ 核心防坑提示(极其重要): 下载完成后,同样右键选择“以管理员身份运行”开始安装。前面一路正常跟随引导点击。 但是!当遇到一个名为 Tools for Native Modules 的页面时,绝对不要勾选 Automatically install the necessary tools. Note that this will also install Chocolatey... 这个选项框! 如果不慎勾选,系统会在后台疯狂下载几十个 G 的无关环境,且国内网络极大概率断连报错,直接卡死整个部署进度。保持该框为空,直接点击 Next 完成安装。

4. 终端环境配置与核心程序全局直装

唤出原生命令提示符: ⚠️ 终端选择防坑: 在 Windows 搜索框中输入 cmd,找到“命令提示符”,右键选择“以管理员身份运行”。请务必使用传统的 CMD,切勿使用 Windows PowerShell,否则后续的命令环境变量极易解析错误。

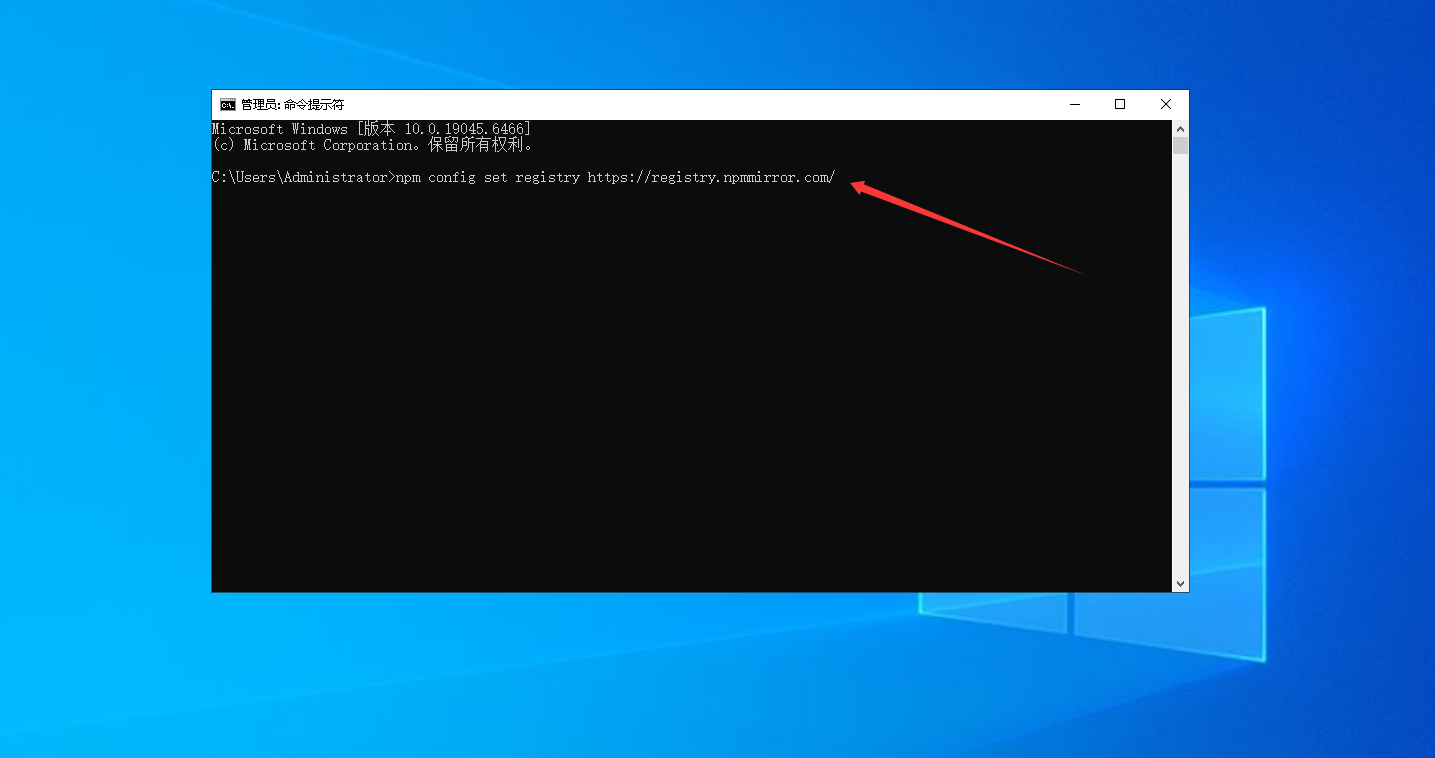

配置 npm 淘宝镜像源(国内节点必配): 在 CMD 终端中输入以下命令并回车,将包管理器切换至国内节点,避免网络超时: npm config set registry https://registry.npmmirror.com/

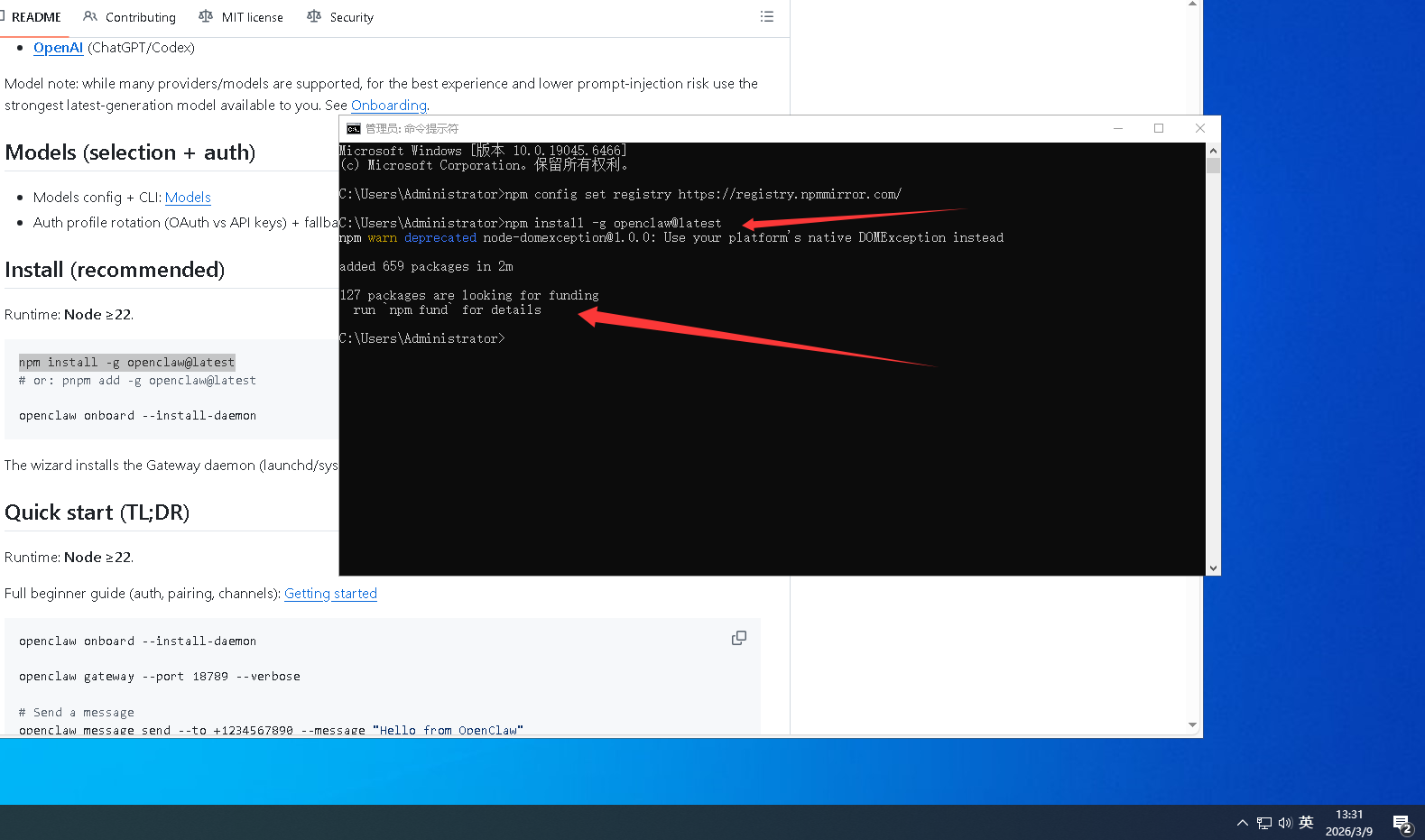

拉取并直装 OpenClaw: 镜像源配置完毕后,直接在 CMD 中输入官方(https://github.com/openclaw/openclaw)提供的全局安装命令并回车: npm install -g openclaw@latest 静待终端跑码,直到进度条走完,核心程序即安装成功。

5. 守护进程初始化与 Web 面板拉起

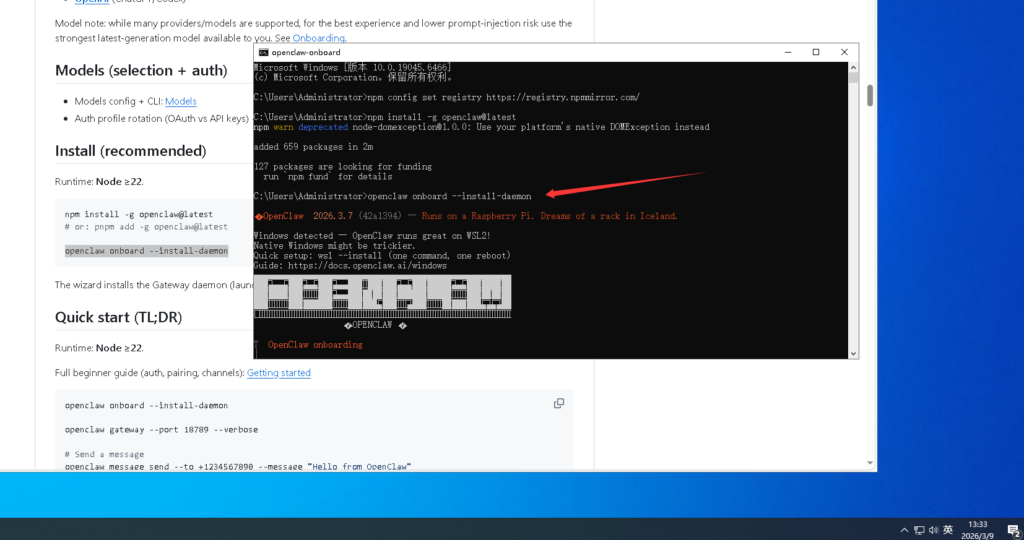

拉起终端交互引导: 在 CMD 中继续输入初始化命令并回车: openclaw onboard --install-daemon

这里的配置流程与之前 Linux 章节完全一模一样。请直接参考上一章的参数注入步骤(配置腾讯云 API、跳过 Skills 等),直到在 TUI 终端中测试对话成功。

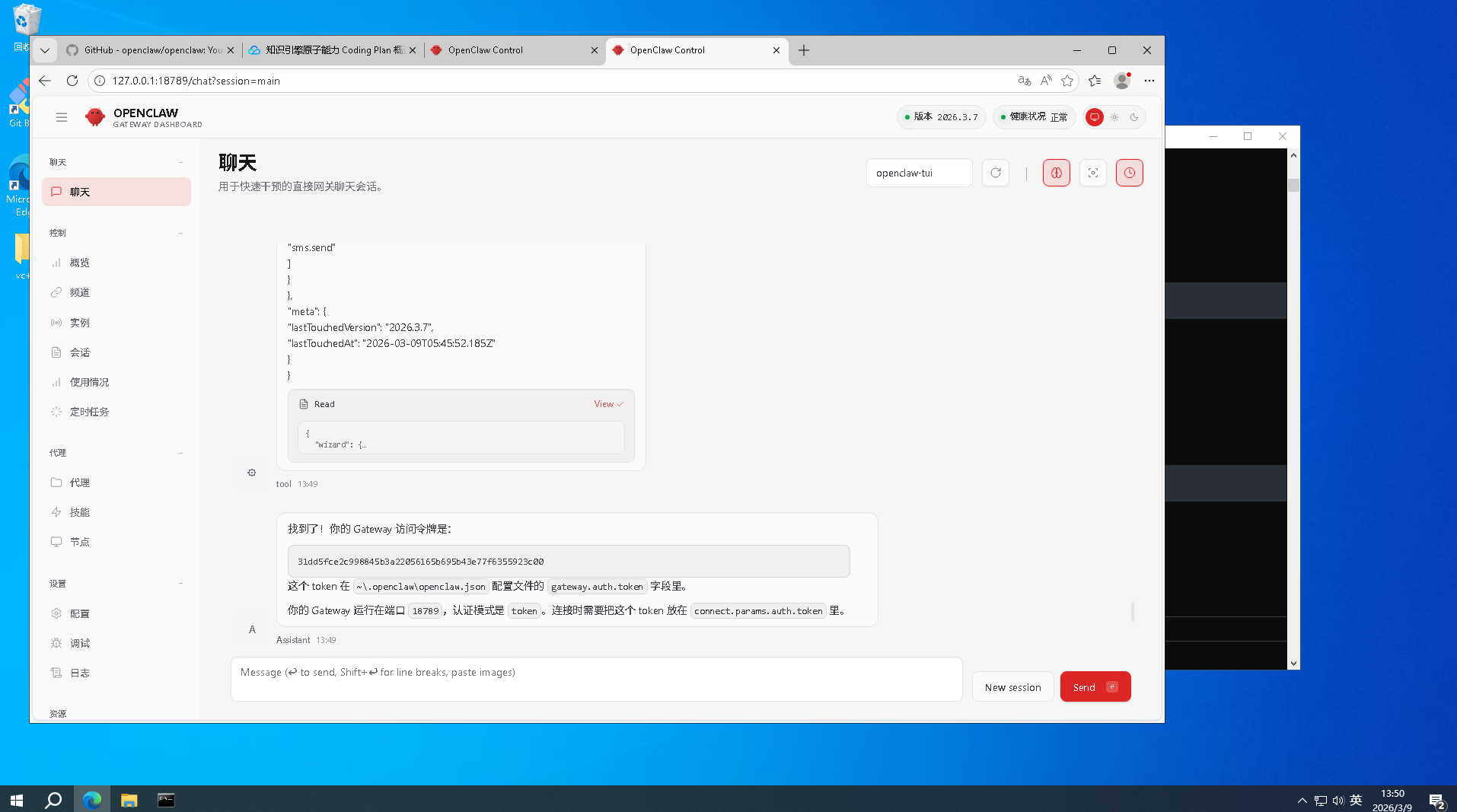

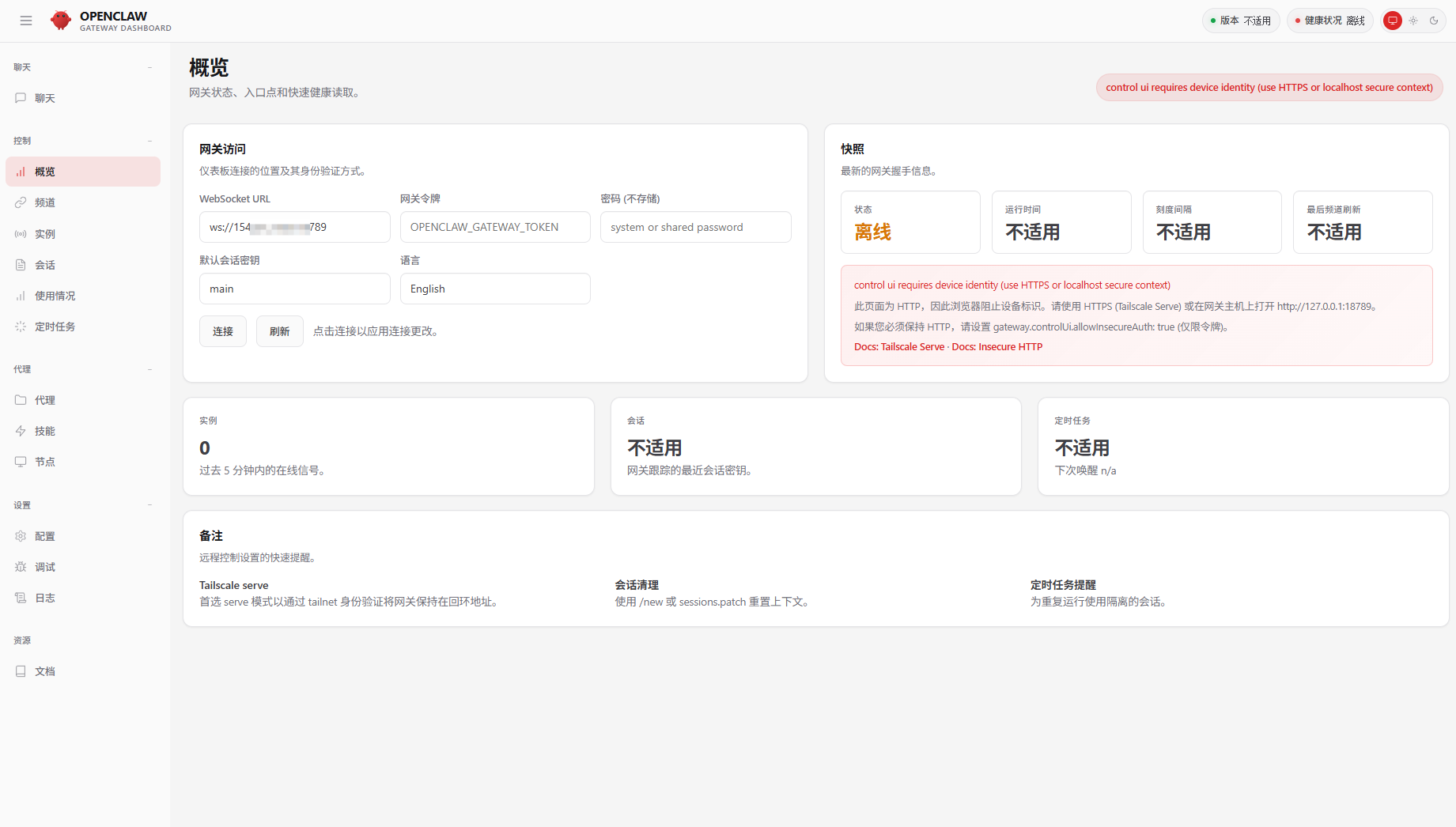

接管 Web UI 控制面板: 与纯命令行的 Linux 服务器不同,既然我们使用的是带有图形桌面的 Windows 系统,就可以毫无障碍地本地直连 Web 面板。 配置完成后,打开你电脑上的任意浏览器,在地址栏输入:127.0.0.1:18789。 此时页面会要求你输入安全令牌。回到你刚刚执行过 openclaw onboard --install-daemon 的 CMD 终端,系统会在配置完成时打印出专属的登录地址和 Token 令牌。将令牌复制并粘贴到浏览器中,即可正式接管这个极客级的 AI 交互后台。

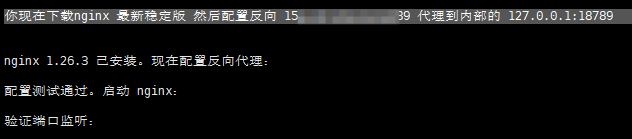

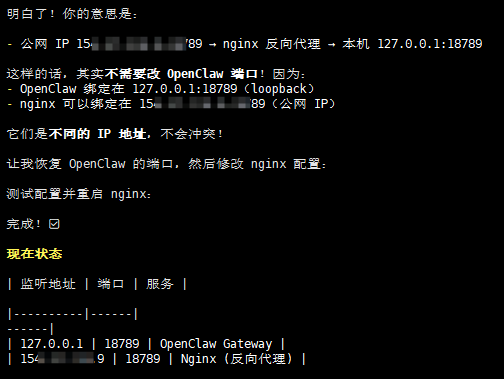

第六章:(可选)配置 Nginx 反向代理与开启 Web UI 界面

⚠️ 极客避坑指南:为什么这一章是“可选”的? 原生命令直装的核心诉求就是轻量与高效。OpenClaw 的 Web UI 界面不仅配置复杂、需要处理 Nginx 反向代理的端口穿透,而且极易出错。更重要的是,在实际业务场景中它几乎起不到决定性作用。相比之下,直接通过 TUI 终端下发命令才是最快、最直接、最不容易踩坑的工作流。

尝试 Web UI 的前置心理准备 如果你依然想折腾体验一下 Web 面板,你需要了解它的核心交互逻辑:在 Web UI 中,你需要直接用自然语言告诉它(AI 助理)你想执行什么系统操作。

模型智商瓶颈与多轮指令 由于我们在第三章接入的是主打高性价比的轻量级模型,它在处理复杂的平台级系统指令时,可能无法一次性精准理解你的意图。你大概率需要多次尝试、换着法子对它下达指令,才能让它成功执行面板操作。

高阶需求:自行接入顶配大模型 如果你希望 Web UI 里的那个 AI 助理能够做到“指哪打哪”、精准理解并执行复杂的底层系统修改,那么你就必须放弃轻量级 API,自行在底层配置中将其替换为逻辑能力更强、参数量更大的顶级大模型。

结语:重塑纯粹的极客工作流

至此,OpenClaw 的纯命令部署与 QQ 机器人接入已全链路跑通。

原生直装的掌控感 摆脱容器化环境的束缚,享受代码与配置改完即刻生效的敏捷工作流,正是这种纯命令行底层部署的核心魅力所在。

进阶与 Debug 底层骨架已搭建完毕,后续大家可自行折腾 Hooks 与 Skills 等高阶扩展。如果在 npm 依赖拉取、初始化参数注入或 QQ 开放平台对接时遇到任何报错卡点,欢迎直接联系我,我们一起排查交流。

如果你觉得命令版很麻烦可以看 Docker-1Panel一键部署教程